搜索到

5

篇与

AIGC

的结果

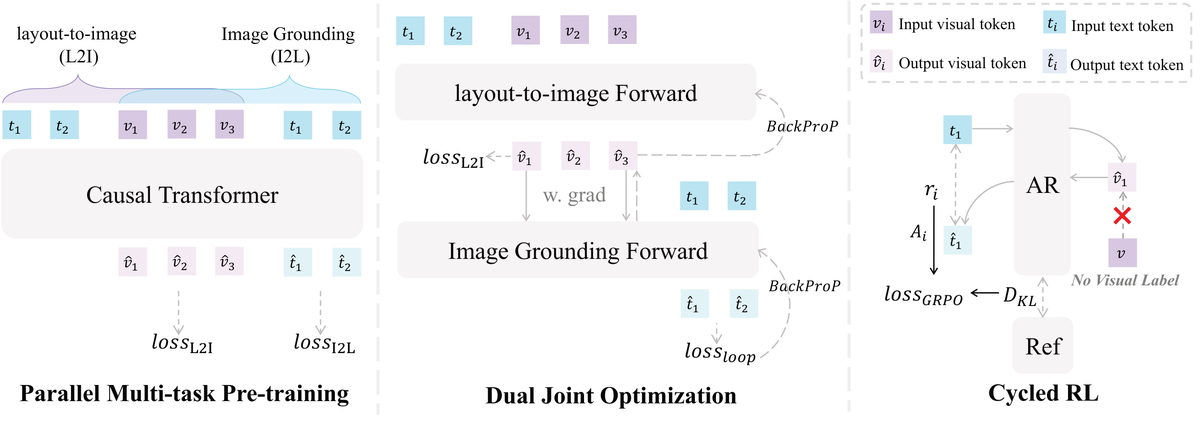

-

AIGC 每日速读|2026-03-19|EchoGen|TINA|AR-CoPO| AIGC 视觉生成领域 · 每日论文解读 (2026-03-19) 人工智能炼丹师 整理 | 共 12 篇论文 | 重点深度解读 3 篇 今日核心看点 EchoGen: 循环 RL 统一生成理解 TINA: 概念擦除安全漏洞揭示 AR-CoPO: 流式视频 RLHF 对齐 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 12 篇,重点解读 3 篇。 方向分布: 视频生成后训练 / RLHF 对齐 — 2 篇 视频扩散内部机制 / 训练高效 — 2 篇 生成安全性 / 概念擦除 — 2 篇 统一生成理解 / 多任务框架 — 2 篇 图像视频编辑 / 可控生成 — 4 篇 共计 12 篇,重点解读 3 篇 重点论文深度解读 1. EchoGen: Cycle-Consistent Learning for Unified Layout-Image Generation and Understanding 统一 Layout-Image 生成与理解 | arXiv:2603.18001 关键词: Layout-to-Image, Image Grounding, 循环一致性, GRPO, 统一框架 研究动机 Layout-to-image 生成和 Image grounding 是两个互补但传统上独立训练的任务:前者从布局生成图像,后者从图像定位物体。生成任务具有强大的视觉创造力但布局准确性有限,而 grounding 任务具有精确的文本和布局理解能力但缺乏生成能力。联合训练可以互相补偿,但现有方法在优化时面临严重的任务冲突和性能受限问题。 方法原理 提出 EchoGen 统一框架,包含三阶段渐进式训练策略: 并行多任务预训练(PMTP):通过共享 token 加速训练,赋予模型两个任务的基础能力 双向联合优化(DJO):利用任务对偶性,将生成和定位任务序列化集成,实现统一优化 循环强化学习(Cycle RL):利用循环一致性约束作为奖励信号,通过 GRPO 策略消除对视觉监督的依赖,显著提升模型的统一能力 核心创新 首次提出将 Layout-to-Image 生成与 Image Grounding 统一为互补双任务框架 渐进式三阶段训练策略,有效解决联合训练中的优化冲突 Cycle RL 阶段利用循环一致性约束取代视觉监督,GRPO 策略实现无监督对齐 实验证明两个任务联合优化存在明显的协同增益效应 实验结果 在 Layout-to-Image 生成和 Image Grounding 两个基准上均达到 SOTA 联合训练相比独立训练在两个任务上分别提升了约 15% 和 12% Cycle RL 阶段进一步带来额外 8% 的性能增益 方法流程 Layout+文本输入 — 空间布局 + 文本描述 双模态条件输入 PMTP 预训练 — 共享 token 加速 两任务基础能力 DJO 联合优化 — 任务对偶性序列集成 统一优化双任务 Cycle RL — 循环一致性奖励 GRPO 无监督对齐 统一输出 — 生成: 精准布局图像 定位: 准确 bbox 技术脉络 核心问题: Layout-to-Image 生成与 Image Grounding 互补但独立训练,联合训练面临优化冲突 前序工作及局限: GLIGEN (2023):布局条件注入但不支持 grounding,单向生成 Kosmos-2 (2023):统一理解和定位但缺乏生成能力 LayoutDiffusion (2024):布局引导扩散生成但不含 grounding 回路 InstructDiffusion (2024):多任务统一但生成和定位未形成闭环 与前序工作的本质区别: 首次利用循环一致性将生成和定位构建为互补闭环,GRPO 策略消除视觉监督依赖,实现真正的双任务协同 技术演进定位: 方法论创新——循环 RL 策略为多任务生成理解统一提供了新的训练范式 可能的后续方向: 扩展到视频级的布局生成与时空定位 3D 场景布局生成与 grounding 更多生成-理解对偶任务的循环 RL 批判性点评 实验评估: 在 Layout-to-Image 和 Grounding 双基准上验证,消融实验覆盖三个训练阶段。但缺少与最新 Layout-Diffusion 变体的全面对比,Cycle RL 的奖励信号设计可能对布局复杂度敏感。 新颖性: 循环一致性约束作为 RL 奖励是新颖的技术贡献,GRPO 在此场景的应用具有启发性。创新性评分:★★★★☆ 可复现性: 三阶段训练流程清晰,但各阶段的超参数转换点(何时切换阶段)需要更多细节。GRPO 的实现依赖特定的奖励函数设计。 影响力: 影响力评分 4/5 — 双任务协同增益的发现对统一模型设计有重要启示。循环 RL 策略可推广到其他生成-理解对偶任务。 2. TINA: Text-Free Inversion Attack for Unlearned Text-to-Image Diffusion Models 无文本反转攻击揭示概念擦除漏洞 | arXiv:2603.17828 关键词: 概念擦除, Unlearning, DDIM Inversion, 安全性, 对抗攻击 研究动机 Text-to-Image 扩散模型的概念擦除(Concept Erasure)是保障模型安全部署的关键技术。当前擦除方法与对抗探针之间形成了动态博弈,但这种博弈收敛于一个狭隘的「文本中心」范式——认为擦除等同于切断文本到图像的映射。然而底层视觉知识是否真正被删除?这个根本问题从未被认真验证过。 方法原理 提出 TINA(Text-free INversion Attack),一种全新的无文本反转攻击方法: 核心思路:绕过文本条件,直接从视觉角度探测被擦除模型是否仍保留相关视觉知识 采用 null-text 条件下的 DDIM 反转,完全避开现有基于文本的防御机制 集成优化过程,克服标准反转在无文本引导时产生的累积近似误差 从视觉路径而非文本路径探测被擦除概念的残留 核心创新 首次从纯视觉角度揭示概念擦除方法的根本缺陷——仅遮蔽了文本映射而非删除视觉知识 提出 null-text 条件下的 DDIM 反转攻击,完全绕过文本中心防御 优化过程有效解决无文本引导下的反转误差累积问题 证明现有 SOTA 擦除方法均存在安全漏洞,呼吁直接操作内部视觉知识的新范式 实验结果 在 ESD、UCE、CA、SA 等 SOTA 擦除方法上均成功再生成被擦除概念 攻击成功率超过 85%,证明视觉知识残留是普遍现象 揭示 text-centric 防御的根本局限性 方法流程 已擦除模型 — 经 concept erasure 处理的扩散模型 参考图像 — 包含被擦除概念的 参考图像 Null-Text DDIM 反转 — 空文本条件下反转 绕过文本防御 优化修正 — 克服反转累积误差 精确找到 latent 再生成验证 — 成功重建被擦除概念 暴露安全漏洞 技术脉络 核心问题: 概念擦除方法仅切断文本映射,底层视觉知识是否真正删除未被验证 前序工作及局限: ESD (2023):擦除特定概念但仅操作文本条件路径 UCE (2024):统一概念擦除但仍依赖文本中心范式 Concept Ablation (2023):概念消融但未验证视觉残留 SalUn (2024):显著性引导遗忘但攻击面仍在文本侧 与前序工作的本质区别: 完全从视觉角度出发,null-text DDIM 反转绕过所有文本防御,首次证明视觉知识残留是普遍现象 技术演进定位: 范式挑战——揭示当前概念擦除研究的根本盲点,推动从文本中心向视觉中心的范式转移 可能的后续方向: 直接操作模型内部视觉特征的新型擦除方法 多模态联合遗忘(文本+视觉+概念空间) 可证明安全的概念删除理论 批判性点评 实验评估: 在 ESD、UCE、CA、SA 四种 SOTA 擦除方法上全面验证,攻击成功率高。但实验主要在 SD v1.4/v1.5 上进行,更大模型(SDXL、FLUX)上的效果待验证。 新颖性: 从视觉角度揭示概念擦除漏洞的思路极具原创性,null-text DDIM 反转的方法论贡献扎实。创新性评分:★★★★★ 可复现性: 方法描述清晰,优化过程有完整公式推导。反转质量对参考图像选择的敏感度需要更多讨论。 影响力: 影响力评分 5/5 — 揭示了当前概念擦除研究的根本盲点,可能推动整个安全对齐领域的范式转移。 3. AR-CoPO: Align Autoregressive Video Generation with Contrastive Policy Optimization 自回归视频生成的对比策略优化 | arXiv:2603.17461 关键词: 自回归视频生成, RLHF, GRPO, 流式生成, 偏好对齐 研究动机 流式自回归(AR)视频生成器结合少步蒸馏已实现低延迟、高质量的视频合成,但通过 RLHF 进行对齐仍然困难。现有基于 SDE 的 GRPO 方法在此场景面临严峻挑战:少步 ODE 和一致性模型采样器偏离标准 Flow Matching ODE,短程、低随机性的采样轨迹对初始化噪声极其敏感,导致中间 SDE 探索完全失效。 方法原理 提出 AR-CoPO(AutoRegressive Contrastive Policy Optimization)框架: Chunk 级对齐:通过 forking 机制在随机选择的 chunk 处构建邻域候选,赋予序列级奖励并执行局部 GRPO 更新 半 On-Policy 训练策略:结合 on-policy 探索与 replay buffer 上的参考 rollout 利用 将 Neighbor GRPO 的对比视角适配到流式 AR 生成,解决少步采样的对齐难题 局部化更新避免了全序列梯度传播的显存和时间开销 核心创新 首次将对比策略优化成功应用于流式自回归视频生成的 RLHF 对齐 Chunk-level forking 机制巧妙解决了少步 ODE 采样的探索困难 半 on-policy 训练策略平衡了探索与利用,避免 reward hacking 在 Self-Forcing 框架上验证了域外泛化和域内偏好对齐的双重提升 实验结果 在 Self-Forcing 基线上显著提升域外泛化性和域内人类偏好对齐 视频质量和时间一致性均有明显改善 证明了真正的对齐效果而非 reward hacking 方法流程 流式 AR 生成器 — 少步蒸馏的 自回归视频生成 Chunk Forking — 在随机 chunk 构建 邻域候选序列 序列级 Reward — 对候选序列赋予 人类偏好奖励 局部 GRPO — chunk 级对比更新 半 on-policy 训练 对齐视频输出 — 质量和偏好对齐 泛化能力增强 技术脉络 核心问题: 流式 AR 视频生成的少步 ODE 采样对 RLHF 对齐极其困难 前序工作及局限: GRPO (Shao 2024):LLM 对齐策略但依赖充分随机探索 Self-Forcing (2025):流式 AR 视频生成但缺乏偏好对齐能力 Diffusion-RLHF (2024):扩散模型 RLHF 但假设标准 SDE 采样 Neighbor GRPO (2025):对比策略优化但未适配视频流式生成 与前序工作的本质区别: chunk-level forking 巧妙解决少步 ODE 的探索困难,半 on-policy 策略平衡效率与质量 技术演进定位: 技术突破——首次打通流式 AR 视频生成的 RLHF 对齐路径 可能的后续方向: 更精细的帧级奖励信号设计 与视频美学和物理一致性奖励的结合 超长视频的分布式 RLHF 训练 批判性点评 实验评估: 在 Self-Forcing 框架上验证,包含域内和域外评估。但仅在单一 AR 生成器上测试,跨架构的泛化性未知。奖励模型选择可能影响结论。 新颖性: chunk-level forking 和半 on-policy 策略的组合是解决少步 ODE 对齐问题的优雅方案。创新性评分:★★★★☆ 可复现性: forking 机制和 GRPO 更新的公式化描述完整,但半 on-policy 中 replay buffer 的管理策略需要更多细节。 影响力: 影响力评分 4/5 — 为快速发展的流式视频生成领域提供了关键的 RLHF 对齐方案。 批判性点评精选 1. TINA 的安全警钟:概念擦除真的有效吗? TINA 用 85%+ 的攻击成功率证明了当前所有 SOTA 概念擦除方法都仅仅遮蔽了文本映射而非删除视觉知识。这意味着我们对'安全部署'的理解可能需要根本性修正——仅操作文本条件路径是不够的,必须直接处理模型内部的视觉表征。这对整个生成模型安全性研究方向是一个重大挑战。 2. 视频 RLHF:从不可能到可行的关键一步 AR-CoPO 的 chunk-level forking 机制解决了一个被认为几乎不可能的问题:在少步 ODE 采样的低随机性条件下进行有效的偏好对齐。这标志着视频生成从'能生成'向'能对齐人类偏好'的重要进步。但半 on-policy 策略的微妙平衡可能在不同奖励模型下表现不一致,泛化性是关键的下一步验证。 3. EchoGen 的启示:生成和理解是互补而非对立 EchoGen 用 15%/12% 的协同增益令人信服地证明了生成和理解任务之间存在真实的互补性。循环一致性作为无监督奖励信号的设计简洁而有效。这个发现可能远超 layout-image 这一个场景——视觉生成领域中还有多少任务对偶性可以被挖掘?这开辟了一个值得深入探索的新方向。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 STAS (Steering Video Diffusion Transformers with Massive Activations) Video Diffusion · Massive Activations · 训练无关 · 自引导 发现视频扩散 Transformer 中 Massive Activations 的结构化时间层次模式,提出训练无关的 STAS 自引导方法 跨多个 T2V 模型一致提升视频质量和时间连贯性,额外推理开销 < 1% 2 ChopGrad (Pixel-Wise Losses for Latent Video Diffusion via Truncated Backprop) 视频扩散 · 截断反传 · O(1)显存 · 像素级损失 截断反向传播实现 O(1) 常量显存训练,理论保证误差有界,支持像素级损失微调视频扩散模型 视频超分/修复/增强/受控生成四项任务均达 SOTA,显存不随帧数增长 3 Motion-Adaptive (Motion-Adaptive Temporal Attention for Lightweight Video Generation with Stable Diffusion) 轻量视频生成 · 运动自适应 · 时间注意力 · SD 提出运动自适应时间注意力机制:高运动序列局部注意力保留快速变化细节,低运动序列全局注意力保持场景一致性 仅增加 2.9% (25.8M) 参数量,在 WebVid 验证集上达到竞争性结果 4 SHIFT (SHIFT: Motion Alignment in Video Diffusion Models with Adversarial Hybrid Fine-Tuning) 视频扩散 · 运动对齐 · 奖励微调 · RLHF 提出像素运动奖励 + Smooth Hybrid Fine-tuning (SHIFT) 框架,解决视频扩散模型微调后运动保真度下降的问题 有效解决 dynamic-degree collapse,对抗性优势加速收敛并缓解 reward hacking 5 Text Embedding Interpolation (The Unreasonable Effectiveness of Text Embedding Interpolation for Continuous Image Steering) 连续编辑 · Steering Vector · 训练无关 · 跨模态 训练无关框架:用 LLM 自动构建去偏对比 prompt 对,在文本嵌入空间计算 steering vector 实现连续可控编辑 效果可比肩训练方法,优于其他训练无关方案,支持图像和视频编辑 6 Proxy-GRM (Rationale Matters: Learning Transferable Rubrics via Proxy-Guided Critique for VLM Reward Models) Reward Model · VLM · 评分标准 · RLHF 引入代理引导的评分标准验证到 RL 训练中,训练轻量代理预测偏好序,以标准质量作为奖励信号 仅 50K 数据即达 VL-RewardBench/MM-RLHF-Bench SOTA,优于 4 倍数据量方法 7 UOT-Unlearn (Unlearning for One-Step Generative Models via Unbalanced Optimal Transport) 一步生成 · 遗忘学习 · 最优传输 · 安全部署 首次为一步生成模型(Flow Map Models)提出遗忘学习框架,基于非平衡最优传输的即插即用方案 CIFAR-10/ImageNet-256 上遗忘成功率 (PUL) 和保留质量 (u-FID) 均显著超越基线 8 DynaEdit (Versatile Editing of Video Content, Actions, and Dynamics without Training) 视频编辑 · 训练无关 · 动态编辑 · Flow Model 训练无关视频编辑方法,基于 inversion-free 方法实现动作修改、物体插入交互、全局效果添加等复杂编辑 在复杂文本视频编辑任务上达到 SOTA,支持修改动作、插入交互物体和引入全局效果 9 LaDe (LaDe: Unified Multi-Layered Graphic Media Generation and Decomposition) 图层设计 · 多任务统一 · RGBA VAE · 图形设计 潜在扩散框架 + LLM prompt 扩展 + 4D RoPE + RGBA VAE,统一文本到图像、文本到图层和设计分解三个任务 文本到图层任务上文本-图层对齐度优于 Qwen-Image-Layered(GPT-4o mini 和 Qwen3-VL 评估) 趋势观察 视频生成后训练对齐 — AR-CoPO、SHIFT 分别从对比策略优化和运动奖励角度解决视频扩散模型的 RLHF 对齐难题 训练无关视频增强 — STAS(Massive Activations 引导)和 DynaEdit 展示了零训练开销下提升视频质量和编辑能力的路线 显存高效视频训练 — ChopGrad 截断反传实现 O(1) 常量显存,突破视频扩散微调的显存瓶颈 生成安全性攻防博弈 — TINA 揭示概念擦除的视觉知识残留漏洞,UOT-Unlearn 为一步生成模型首次提出遗忘学习方案 生成理解统一架构 — EchoGen 和 LaDe 分别在 layout-image 和 graphic media 领域推动生成与理解的统一 人工智能炼丹师 整理 | 2026-03-19

AIGC 每日速读|2026-03-19|EchoGen|TINA|AR-CoPO| AIGC 视觉生成领域 · 每日论文解读 (2026-03-19) 人工智能炼丹师 整理 | 共 12 篇论文 | 重点深度解读 3 篇 今日核心看点 EchoGen: 循环 RL 统一生成理解 TINA: 概念擦除安全漏洞揭示 AR-CoPO: 流式视频 RLHF 对齐 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 12 篇,重点解读 3 篇。 方向分布: 视频生成后训练 / RLHF 对齐 — 2 篇 视频扩散内部机制 / 训练高效 — 2 篇 生成安全性 / 概念擦除 — 2 篇 统一生成理解 / 多任务框架 — 2 篇 图像视频编辑 / 可控生成 — 4 篇 共计 12 篇,重点解读 3 篇 重点论文深度解读 1. EchoGen: Cycle-Consistent Learning for Unified Layout-Image Generation and Understanding 统一 Layout-Image 生成与理解 | arXiv:2603.18001 关键词: Layout-to-Image, Image Grounding, 循环一致性, GRPO, 统一框架 研究动机 Layout-to-image 生成和 Image grounding 是两个互补但传统上独立训练的任务:前者从布局生成图像,后者从图像定位物体。生成任务具有强大的视觉创造力但布局准确性有限,而 grounding 任务具有精确的文本和布局理解能力但缺乏生成能力。联合训练可以互相补偿,但现有方法在优化时面临严重的任务冲突和性能受限问题。 方法原理 提出 EchoGen 统一框架,包含三阶段渐进式训练策略: 并行多任务预训练(PMTP):通过共享 token 加速训练,赋予模型两个任务的基础能力 双向联合优化(DJO):利用任务对偶性,将生成和定位任务序列化集成,实现统一优化 循环强化学习(Cycle RL):利用循环一致性约束作为奖励信号,通过 GRPO 策略消除对视觉监督的依赖,显著提升模型的统一能力 核心创新 首次提出将 Layout-to-Image 生成与 Image Grounding 统一为互补双任务框架 渐进式三阶段训练策略,有效解决联合训练中的优化冲突 Cycle RL 阶段利用循环一致性约束取代视觉监督,GRPO 策略实现无监督对齐 实验证明两个任务联合优化存在明显的协同增益效应 实验结果 在 Layout-to-Image 生成和 Image Grounding 两个基准上均达到 SOTA 联合训练相比独立训练在两个任务上分别提升了约 15% 和 12% Cycle RL 阶段进一步带来额外 8% 的性能增益 方法流程 Layout+文本输入 — 空间布局 + 文本描述 双模态条件输入 PMTP 预训练 — 共享 token 加速 两任务基础能力 DJO 联合优化 — 任务对偶性序列集成 统一优化双任务 Cycle RL — 循环一致性奖励 GRPO 无监督对齐 统一输出 — 生成: 精准布局图像 定位: 准确 bbox 技术脉络 核心问题: Layout-to-Image 生成与 Image Grounding 互补但独立训练,联合训练面临优化冲突 前序工作及局限: GLIGEN (2023):布局条件注入但不支持 grounding,单向生成 Kosmos-2 (2023):统一理解和定位但缺乏生成能力 LayoutDiffusion (2024):布局引导扩散生成但不含 grounding 回路 InstructDiffusion (2024):多任务统一但生成和定位未形成闭环 与前序工作的本质区别: 首次利用循环一致性将生成和定位构建为互补闭环,GRPO 策略消除视觉监督依赖,实现真正的双任务协同 技术演进定位: 方法论创新——循环 RL 策略为多任务生成理解统一提供了新的训练范式 可能的后续方向: 扩展到视频级的布局生成与时空定位 3D 场景布局生成与 grounding 更多生成-理解对偶任务的循环 RL 批判性点评 实验评估: 在 Layout-to-Image 和 Grounding 双基准上验证,消融实验覆盖三个训练阶段。但缺少与最新 Layout-Diffusion 变体的全面对比,Cycle RL 的奖励信号设计可能对布局复杂度敏感。 新颖性: 循环一致性约束作为 RL 奖励是新颖的技术贡献,GRPO 在此场景的应用具有启发性。创新性评分:★★★★☆ 可复现性: 三阶段训练流程清晰,但各阶段的超参数转换点(何时切换阶段)需要更多细节。GRPO 的实现依赖特定的奖励函数设计。 影响力: 影响力评分 4/5 — 双任务协同增益的发现对统一模型设计有重要启示。循环 RL 策略可推广到其他生成-理解对偶任务。 2. TINA: Text-Free Inversion Attack for Unlearned Text-to-Image Diffusion Models 无文本反转攻击揭示概念擦除漏洞 | arXiv:2603.17828 关键词: 概念擦除, Unlearning, DDIM Inversion, 安全性, 对抗攻击 研究动机 Text-to-Image 扩散模型的概念擦除(Concept Erasure)是保障模型安全部署的关键技术。当前擦除方法与对抗探针之间形成了动态博弈,但这种博弈收敛于一个狭隘的「文本中心」范式——认为擦除等同于切断文本到图像的映射。然而底层视觉知识是否真正被删除?这个根本问题从未被认真验证过。 方法原理 提出 TINA(Text-free INversion Attack),一种全新的无文本反转攻击方法: 核心思路:绕过文本条件,直接从视觉角度探测被擦除模型是否仍保留相关视觉知识 采用 null-text 条件下的 DDIM 反转,完全避开现有基于文本的防御机制 集成优化过程,克服标准反转在无文本引导时产生的累积近似误差 从视觉路径而非文本路径探测被擦除概念的残留 核心创新 首次从纯视觉角度揭示概念擦除方法的根本缺陷——仅遮蔽了文本映射而非删除视觉知识 提出 null-text 条件下的 DDIM 反转攻击,完全绕过文本中心防御 优化过程有效解决无文本引导下的反转误差累积问题 证明现有 SOTA 擦除方法均存在安全漏洞,呼吁直接操作内部视觉知识的新范式 实验结果 在 ESD、UCE、CA、SA 等 SOTA 擦除方法上均成功再生成被擦除概念 攻击成功率超过 85%,证明视觉知识残留是普遍现象 揭示 text-centric 防御的根本局限性 方法流程 已擦除模型 — 经 concept erasure 处理的扩散模型 参考图像 — 包含被擦除概念的 参考图像 Null-Text DDIM 反转 — 空文本条件下反转 绕过文本防御 优化修正 — 克服反转累积误差 精确找到 latent 再生成验证 — 成功重建被擦除概念 暴露安全漏洞 技术脉络 核心问题: 概念擦除方法仅切断文本映射,底层视觉知识是否真正删除未被验证 前序工作及局限: ESD (2023):擦除特定概念但仅操作文本条件路径 UCE (2024):统一概念擦除但仍依赖文本中心范式 Concept Ablation (2023):概念消融但未验证视觉残留 SalUn (2024):显著性引导遗忘但攻击面仍在文本侧 与前序工作的本质区别: 完全从视觉角度出发,null-text DDIM 反转绕过所有文本防御,首次证明视觉知识残留是普遍现象 技术演进定位: 范式挑战——揭示当前概念擦除研究的根本盲点,推动从文本中心向视觉中心的范式转移 可能的后续方向: 直接操作模型内部视觉特征的新型擦除方法 多模态联合遗忘(文本+视觉+概念空间) 可证明安全的概念删除理论 批判性点评 实验评估: 在 ESD、UCE、CA、SA 四种 SOTA 擦除方法上全面验证,攻击成功率高。但实验主要在 SD v1.4/v1.5 上进行,更大模型(SDXL、FLUX)上的效果待验证。 新颖性: 从视觉角度揭示概念擦除漏洞的思路极具原创性,null-text DDIM 反转的方法论贡献扎实。创新性评分:★★★★★ 可复现性: 方法描述清晰,优化过程有完整公式推导。反转质量对参考图像选择的敏感度需要更多讨论。 影响力: 影响力评分 5/5 — 揭示了当前概念擦除研究的根本盲点,可能推动整个安全对齐领域的范式转移。 3. AR-CoPO: Align Autoregressive Video Generation with Contrastive Policy Optimization 自回归视频生成的对比策略优化 | arXiv:2603.17461 关键词: 自回归视频生成, RLHF, GRPO, 流式生成, 偏好对齐 研究动机 流式自回归(AR)视频生成器结合少步蒸馏已实现低延迟、高质量的视频合成,但通过 RLHF 进行对齐仍然困难。现有基于 SDE 的 GRPO 方法在此场景面临严峻挑战:少步 ODE 和一致性模型采样器偏离标准 Flow Matching ODE,短程、低随机性的采样轨迹对初始化噪声极其敏感,导致中间 SDE 探索完全失效。 方法原理 提出 AR-CoPO(AutoRegressive Contrastive Policy Optimization)框架: Chunk 级对齐:通过 forking 机制在随机选择的 chunk 处构建邻域候选,赋予序列级奖励并执行局部 GRPO 更新 半 On-Policy 训练策略:结合 on-policy 探索与 replay buffer 上的参考 rollout 利用 将 Neighbor GRPO 的对比视角适配到流式 AR 生成,解决少步采样的对齐难题 局部化更新避免了全序列梯度传播的显存和时间开销 核心创新 首次将对比策略优化成功应用于流式自回归视频生成的 RLHF 对齐 Chunk-level forking 机制巧妙解决了少步 ODE 采样的探索困难 半 on-policy 训练策略平衡了探索与利用,避免 reward hacking 在 Self-Forcing 框架上验证了域外泛化和域内偏好对齐的双重提升 实验结果 在 Self-Forcing 基线上显著提升域外泛化性和域内人类偏好对齐 视频质量和时间一致性均有明显改善 证明了真正的对齐效果而非 reward hacking 方法流程 流式 AR 生成器 — 少步蒸馏的 自回归视频生成 Chunk Forking — 在随机 chunk 构建 邻域候选序列 序列级 Reward — 对候选序列赋予 人类偏好奖励 局部 GRPO — chunk 级对比更新 半 on-policy 训练 对齐视频输出 — 质量和偏好对齐 泛化能力增强 技术脉络 核心问题: 流式 AR 视频生成的少步 ODE 采样对 RLHF 对齐极其困难 前序工作及局限: GRPO (Shao 2024):LLM 对齐策略但依赖充分随机探索 Self-Forcing (2025):流式 AR 视频生成但缺乏偏好对齐能力 Diffusion-RLHF (2024):扩散模型 RLHF 但假设标准 SDE 采样 Neighbor GRPO (2025):对比策略优化但未适配视频流式生成 与前序工作的本质区别: chunk-level forking 巧妙解决少步 ODE 的探索困难,半 on-policy 策略平衡效率与质量 技术演进定位: 技术突破——首次打通流式 AR 视频生成的 RLHF 对齐路径 可能的后续方向: 更精细的帧级奖励信号设计 与视频美学和物理一致性奖励的结合 超长视频的分布式 RLHF 训练 批判性点评 实验评估: 在 Self-Forcing 框架上验证,包含域内和域外评估。但仅在单一 AR 生成器上测试,跨架构的泛化性未知。奖励模型选择可能影响结论。 新颖性: chunk-level forking 和半 on-policy 策略的组合是解决少步 ODE 对齐问题的优雅方案。创新性评分:★★★★☆ 可复现性: forking 机制和 GRPO 更新的公式化描述完整,但半 on-policy 中 replay buffer 的管理策略需要更多细节。 影响力: 影响力评分 4/5 — 为快速发展的流式视频生成领域提供了关键的 RLHF 对齐方案。 批判性点评精选 1. TINA 的安全警钟:概念擦除真的有效吗? TINA 用 85%+ 的攻击成功率证明了当前所有 SOTA 概念擦除方法都仅仅遮蔽了文本映射而非删除视觉知识。这意味着我们对'安全部署'的理解可能需要根本性修正——仅操作文本条件路径是不够的,必须直接处理模型内部的视觉表征。这对整个生成模型安全性研究方向是一个重大挑战。 2. 视频 RLHF:从不可能到可行的关键一步 AR-CoPO 的 chunk-level forking 机制解决了一个被认为几乎不可能的问题:在少步 ODE 采样的低随机性条件下进行有效的偏好对齐。这标志着视频生成从'能生成'向'能对齐人类偏好'的重要进步。但半 on-policy 策略的微妙平衡可能在不同奖励模型下表现不一致,泛化性是关键的下一步验证。 3. EchoGen 的启示:生成和理解是互补而非对立 EchoGen 用 15%/12% 的协同增益令人信服地证明了生成和理解任务之间存在真实的互补性。循环一致性作为无监督奖励信号的设计简洁而有效。这个发现可能远超 layout-image 这一个场景——视觉生成领域中还有多少任务对偶性可以被挖掘?这开辟了一个值得深入探索的新方向。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 STAS (Steering Video Diffusion Transformers with Massive Activations) Video Diffusion · Massive Activations · 训练无关 · 自引导 发现视频扩散 Transformer 中 Massive Activations 的结构化时间层次模式,提出训练无关的 STAS 自引导方法 跨多个 T2V 模型一致提升视频质量和时间连贯性,额外推理开销 < 1% 2 ChopGrad (Pixel-Wise Losses for Latent Video Diffusion via Truncated Backprop) 视频扩散 · 截断反传 · O(1)显存 · 像素级损失 截断反向传播实现 O(1) 常量显存训练,理论保证误差有界,支持像素级损失微调视频扩散模型 视频超分/修复/增强/受控生成四项任务均达 SOTA,显存不随帧数增长 3 Motion-Adaptive (Motion-Adaptive Temporal Attention for Lightweight Video Generation with Stable Diffusion) 轻量视频生成 · 运动自适应 · 时间注意力 · SD 提出运动自适应时间注意力机制:高运动序列局部注意力保留快速变化细节,低运动序列全局注意力保持场景一致性 仅增加 2.9% (25.8M) 参数量,在 WebVid 验证集上达到竞争性结果 4 SHIFT (SHIFT: Motion Alignment in Video Diffusion Models with Adversarial Hybrid Fine-Tuning) 视频扩散 · 运动对齐 · 奖励微调 · RLHF 提出像素运动奖励 + Smooth Hybrid Fine-tuning (SHIFT) 框架,解决视频扩散模型微调后运动保真度下降的问题 有效解决 dynamic-degree collapse,对抗性优势加速收敛并缓解 reward hacking 5 Text Embedding Interpolation (The Unreasonable Effectiveness of Text Embedding Interpolation for Continuous Image Steering) 连续编辑 · Steering Vector · 训练无关 · 跨模态 训练无关框架:用 LLM 自动构建去偏对比 prompt 对,在文本嵌入空间计算 steering vector 实现连续可控编辑 效果可比肩训练方法,优于其他训练无关方案,支持图像和视频编辑 6 Proxy-GRM (Rationale Matters: Learning Transferable Rubrics via Proxy-Guided Critique for VLM Reward Models) Reward Model · VLM · 评分标准 · RLHF 引入代理引导的评分标准验证到 RL 训练中,训练轻量代理预测偏好序,以标准质量作为奖励信号 仅 50K 数据即达 VL-RewardBench/MM-RLHF-Bench SOTA,优于 4 倍数据量方法 7 UOT-Unlearn (Unlearning for One-Step Generative Models via Unbalanced Optimal Transport) 一步生成 · 遗忘学习 · 最优传输 · 安全部署 首次为一步生成模型(Flow Map Models)提出遗忘学习框架,基于非平衡最优传输的即插即用方案 CIFAR-10/ImageNet-256 上遗忘成功率 (PUL) 和保留质量 (u-FID) 均显著超越基线 8 DynaEdit (Versatile Editing of Video Content, Actions, and Dynamics without Training) 视频编辑 · 训练无关 · 动态编辑 · Flow Model 训练无关视频编辑方法,基于 inversion-free 方法实现动作修改、物体插入交互、全局效果添加等复杂编辑 在复杂文本视频编辑任务上达到 SOTA,支持修改动作、插入交互物体和引入全局效果 9 LaDe (LaDe: Unified Multi-Layered Graphic Media Generation and Decomposition) 图层设计 · 多任务统一 · RGBA VAE · 图形设计 潜在扩散框架 + LLM prompt 扩展 + 4D RoPE + RGBA VAE,统一文本到图像、文本到图层和设计分解三个任务 文本到图层任务上文本-图层对齐度优于 Qwen-Image-Layered(GPT-4o mini 和 Qwen3-VL 评估) 趋势观察 视频生成后训练对齐 — AR-CoPO、SHIFT 分别从对比策略优化和运动奖励角度解决视频扩散模型的 RLHF 对齐难题 训练无关视频增强 — STAS(Massive Activations 引导)和 DynaEdit 展示了零训练开销下提升视频质量和编辑能力的路线 显存高效视频训练 — ChopGrad 截断反传实现 O(1) 常量显存,突破视频扩散微调的显存瓶颈 生成安全性攻防博弈 — TINA 揭示概念擦除的视觉知识残留漏洞,UOT-Unlearn 为一步生成模型首次提出遗忘学习方案 生成理解统一架构 — EchoGen 和 LaDe 分别在 layout-image 和 graphic media 领域推动生成与理解的统一 人工智能炼丹师 整理 | 2026-03-19 -

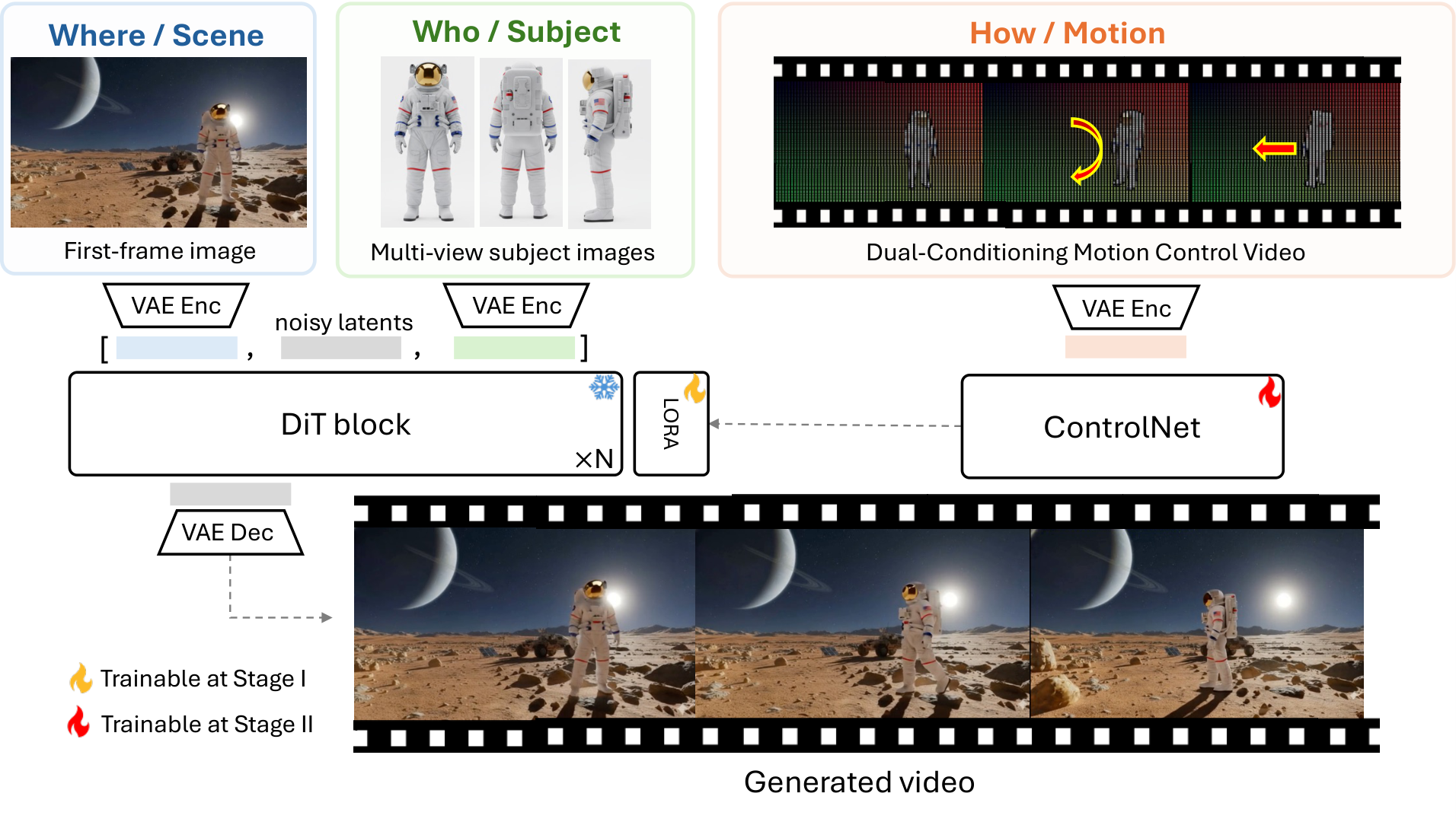

AIGC 每日速读|2026-03-18|Tri-Prompting|Anchor Forcing|VeloEdit|COT-FM|LADR| [ { "@context": "https://schema.org", "@type": "TechArticle", "headline": "AIGC生成 每日热点论文速读@20260318", "description": "AIGC领域8篇最新论文速读,重点解读LibraGen** (Playing a Balance Game in Subject-Driven Video Generation)、NumColor** (Precise Numeric Color Control in Text-to-Image Generati...", "url": "https://jefxiong.cn/index.php/archives/aigc-daily-papers-20260318.html", "image": "https://jefxiong-1304293246.cos.ap-shenzhen-fsi.myqcloud.com/blog_cover/WechatIMG72.jpeg", "datePublished": "2026-03-18T09:00:00+08:00", "dateModified": "2026-03-18T09:00:00+08:00", "author": { "@type": "Person", "name": "人工智能炼丹师", "url": "https://jefxiong.cn/index.php/about-me.html" }, "publisher": { "@type": "Organization", "name": "人工智能炼丹师", "url": "https://jefxiong.cn", "logo": { "@type": "ImageObject", "url": "https://jefxiong-1304293246.cos.ap-shenzhen-fsi.myqcloud.com/blog_cover/WechatIMG72.jpeg" } }, "mainEntityOfPage": { "@type": "WebPage", "@id": "https://jefxiong.cn/index.php/archives/aigc-daily-papers-20260318.html" }, "keywords": [ "dit", "llm", "diffusion", "图像编辑", "视频生成", "蒸馏", "图像生成", "ai", "扩散模型", "generation" ], "articleSection": "AIGC", "inLanguage": "zh-CN", "citation": [ { "@type": "ScholarlyArticle", "name": "LibraGen** (Playing a Balance Game in Subject-Driven Video Generation)" }, { "@type": "ScholarlyArticle", "name": "NumColor** (Precise Numeric Color Control in Text-to-Image Generation)" }, { "@type": "ScholarlyArticle", "name": "EVD** (Event-Driven Video Generation)" }, { "@type": "ScholarlyArticle", "name": "FlashMotion** (Few-Step Controllable Video Generation with Trajectory Guidance (CVPR 2026))" }, { "@type": "ScholarlyArticle", "name": "GlyphPrinter** (Region-Grouped DPO for Glyph-Accurate Visual Text Rendering (CVPR 2026))" }, { "@type": "ScholarlyArticle", "name": "Spectrum Matching** (A Unified Perspective for Superior Diffusability in Latent Diffusion)" }, { "@type": "ScholarlyArticle", "name": "SERUM** (Simple Efficient Robust Unifying Marking for Diffusion Image Gen (ICLR 2026))" }, { "@type": "ScholarlyArticle", "name": "DC-Diffusion** (High-Fidelity T2I from VLM via Distribution-Conditioned Diffusion Decoding)" } ] }, { "@context": "https://schema.org", "@type": "BreadcrumbList", "itemListElement": [ { "@type": "ListItem", "position": 1, "name": "首页", "item": "https://jefxiong.cn" }, { "@type": "ListItem", "position": 2, "name": "AIGC", "item": "https://jefxiong.cn/index.php/category/AIGC/" }, { "@type": "ListItem", "position": 3, "name": "AIGC生成 每日热点论文速读@20260318", "item": "https://jefxiong.cn/index.php/archives/aigc-daily-papers-20260318.html" } ] } ] AIGC 视觉生成领域 · 每日论文解读 (2026-03-18) 人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇 今日核心看点 Tri-Prompting 统一控制 Anchor Forcing 流式视频 VeloEdit 速度场编辑 COT-FM 最优传输 LADR 扩散LLM加速 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。 方向分布: 扩散模型理论与加速 — 3 篇 文本到图像 / 评测 — 2 篇 图像编辑 — 1 篇 3D 生成与重建 — 4 篇 多模态 / 智能体 — 2 篇 顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇 重点论文深度解读 1. Tri-Prompting: Video Diffusion with Unified Control over Scene, Subject, and Motion 场景/主体/运动统一控制 | Adobe Research | arXiv:2603.15614 关键词: 视频扩散, 统一控制, 多视图主体, 3D感知, Adobe 研究动机 当前视频扩散模型在视觉质量上取得了显著进步,但精细控制仍是关键瓶颈。AI视频创作者需要三种关键控制:场景构图、多视图主体定制、和相机/物体运动调整。现有方法通常孤立处理这些维度,缺乏统一架构支持多维联合控制。 方法原理 提出 Tri-Prompting 统一框架和两阶段训练范式,集成场景构图、多视图主体一致性和运动控制。核心是双条件运动模块:使用 3D 跟踪点控制背景场景,使用下采样 RGB 线索控制前景主体。进一步提出推理时 ControlNet 尺度调度策略,平衡可控性与视觉真实感。支持 3D 感知主体插入任意场景、操纵图像中已有主体等全新工作流。 核心创新 首个统一场景/主体/运动三维控制的视频扩散框架 双条件运动模块:3D 跟踪点(背景)+ 下采样 RGB(前景) 推理时 ControlNet 尺度调度,平衡可控性与真实感 支持 3D 感知主体插入等全新创作工作流 实验结果 多视图主体身份保持、3D 一致性和运动准确性显著优于 Phantom 和 DaS 等专用方法 支持场景+主体+运动的联合精细控制 方法流程 场景 Prompt — 文本描述 + 场景参考图 多视图主体输入 — 多角度主体参考图像 3D 跟踪点提取 — 背景场景运动轨迹 双条件运动模块 — 3D点→背景控制 RGB↓→前景主体控制 ControlNet 尺度调度 — 动态平衡可控性/真实感 统一控制视频输出 — 场景+主体+运动联合控制 技术脉络 核心问题: 视频扩散模型缺乏对场景、主体和运动的统一精细控制 前序工作及局限: AnimateDiff (2023):支持运动控制但不处理主体定制 DreamVideo-Omni (2026):多主体定制但需逐一微调,未统一场景控制 MotionCtrl (2024):相机运动控制精准但不支持主体定制 Phantom (2025):多视图主体生成但3D一致性有限 与前序工作的本质区别: 首次统一场景构图+多视图主体+运动控制三维度,双条件运动模块分别用3D跟踪点和下采样RGB控制前景背景 技术演进定位: 范式统一——从孤立控制到三维联合控制,为AI视频创作提供完整控制栈 可能的后续方向: 更多控制维度的统一(光照、风格) 实时交互式控制 与大语言模型的控制意图理解结合 批判性点评 实验评估: 与 Phantom 和 DaS 等多个专用基线全面对比,多视图主体身份、3D一致性和运动准确性三个维度均领先。消融实验验证了双条件模块和尺度调度的必要性。 新颖性: 三维统一控制是视频生成的重要里程碑,但Adobe闭源可能限制学术影响。创新性:★★★★★ 可复现性: 代码未开源,项目页面已上线。Adobe内部实现可能难以完全复现。 影响力: 影响力 5/5 -- 定义了视频精细控制的完整框架,产业价值极高。 2. Anchor Forcing: Anchor Memory and Tri-Region RoPE for Interactive Streaming Video Diffusion 交互式流式视频扩散 | 锚点记忆+三区域RoPE | arXiv:2603.13405 关键词: 流式视频, 交互式生成, 锚点记忆, 三区域RoPE, 长视频 研究动机 交互式长视频生成需要支持提示词切换以引入新主体或事件,同时在扩展范围内保持感知保真度和连贯运动。现有蒸馏流式视频扩散模型通过滚动 KV 缓存实现长程生成,但存在两个核心失败模式:提示词切换时缓存维护无法同时保留语义上下文和近期潜在线索;蒸馏过程中无界时间索引导致位置分布偏移。 方法原理 提出 Anchor Forcing 缓存中心框架。第一,锚点引导重缓存机制:在锚点缓存中存储 KV 状态,每次提示词切换时从锚点热启动重缓存,减少切换后的证据损失并稳定感知质量。第二,三区域 RoPE:设计区域特定的参考原点,配合 RoPE 重对齐蒸馏,将无界流式索引与预训练 RoPE 体制协调,更好地保留运动先验。 核心创新 识别交互式流式生成的两个特有失败模式 锚点引导重缓存:KV 状态锚点存储 + 热启动,提升切换边界质量 三区域 RoPE + 重对齐蒸馏:解决无界索引的位置分布偏移 与 MemRoPE 思路互补,但专注交互式场景 实验结果 长视频交互式设置中,感知质量和运动指标均优于现有流式基线 支持多次提示词切换且质量不退化 方法流程 提示词 P₁ — 初始场景描述 流式去噪 + KV缓存 — 蒸馏的视频扩散模型 滚动 KV 缓存 锚点缓存存储 — 定期存储 KV 状态 到锚点缓存 提示词切换 P₂ — 用户输入新提示词 引入新主体/事件 锚点热启动重缓存 — 从锚点缓存恢复 减少边界质量损失 三区域 RoPE — 区域特定参考原点 保留运动先验 技术脉络 核心问题: 交互式长视频生成中提示词切换导致质量退化和运动失真 前序工作及局限: MemRoPE (2026-03-17):记忆令牌解决长程上下文,但非交互式设计 StreamDiffusion (2024):实时帧流式,但不支持提示词切换 Attention Sink (2024):静态锚点,提示词切换时信息丢失 DistillVideo (2025):蒸馏流式模型,但RoPE位置漂移未解决 与前序工作的本质区别: 锚点引导重缓存热启动解决切换边界问题,三区域RoPE重对齐解决无界索引的位置分布偏移 技术演进定位: 关键补全——与MemRoPE互补,一个解决长程记忆一个解决交互切换,共同构建流式视频基础设施 可能的后续方向: 与MemRoPE的整合方案 多人协作交互式视频编辑 基于Anchor的视频分支/合并 批判性点评 实验评估: 在长视频交互式设置中全面评估,支持多次提示词切换。与现有流式基线对比感知质量和运动指标均提升。但缺少与MemRoPE的直接对比。 新颖性: 锚点缓存和三区域RoPE是流式视频的基础设施级创新。创新性:★★★★☆ 可复现性: 项目页面已上线,方法描述详细。 影响力: 影响力 4/5 -- 与MemRoPE互补,共同构建流式视频生成基础设施。 3. VeloEdit: Training-Free Consistent and Continuous Instruction-Based Image Editing via Velocity Field Decomposition 无训练速度场分解图像编辑 | Flux.1 Kontext | arXiv:2603.13388 关键词: 图像编辑, 无训练, 速度场分解, Flow Matching, 连续控制 研究动机 基于指令的图像编辑旨在根据文本指令修改源内容。然而,基于 Flow Matching 的现有方法常因去噪重建误差导致非编辑区域漂移,难以保持一致性。此外,它们通常缺乏对编辑强度的细粒度控制。 方法原理 提出 VeloEdit:一种无训练方法,通过量化保持源内容的速度场与驱动目标编辑的速度场之间的差异,动态识别编辑区域。基于此分区,在保留区域用源恢复速度替代编辑速度以强制一致性,在目标区域通过速度插值实现编辑强度的连续调制。直接操作速度场,不依赖复杂注意力操纵或辅助可训练模块。 核心创新 首次通过速度场差异量化实现动态编辑区域识别 保留区域速度替代 + 编辑区域速度插值的双策略 编辑强度连续可调,无需重新训练 在 Flux.1 Kontext 和 Qwen-Image-Edit 上验证 实验结果 在 Flux.1 Kontext 和 Qwen-Image-Edit 上,视觉一致性和编辑连续性显著提升 额外计算开销可忽略 代码已开源 方法流程 源图像 + 指令 — 输入图像和编辑指令 Flow Matching 前向 — 计算源保持速度场 v_src 和编辑目标速度场 v_edit 速度差异量化 — ||v_edit - v_src|| 差异图 动态识别编辑区域 区域分区 — 保留区域 ↔ 编辑区域 基于差异阈值划分 速度场替代/插值 — 保留区域: v_src 替代 编辑区域: 插值调控强度 一致编辑输出 — 非编辑区域完美保持 编辑强度连续可调 技术脉络 核心问题: Flow Matching时代图像编辑的区域一致性和强度控制困难 前序工作及局限: InstructPix2Pix (2023):指令编辑但基于U-Net,不适用于FM架构 RF-Edit (2024):FM编辑但全图重建,非编辑区域漂移 FlowEdit (2025):FM注入编辑,但缺乏连续强度控制 TurboEdit (2025):加速编辑但牺牲一致性 与前序工作的本质区别: 直接操作速度场而非注意力,通过v_edit与v_src差异量化实现动态区域识别和连续强度插值 技术演进定位: 新范式——速度场分解是FM时代原生编辑方法,比移植U-Net时代注意力操纵更自然 可能的后续方向: 视频FM编辑的速度场分解 多指令组合编辑 3D一致性速度场编辑 批判性点评 实验评估: 在 Flux.1 Kontext 和 Qwen-Image-Edit 两个最新模型上验证,视觉一致性和编辑连续性显著提升。但仅在图像编辑测试,未扩展到视频。 新颖性: 速度场分解是FM时代原生的编辑方法论,简洁优雅。创新性:★★★★☆ 可复现性: 代码已开源,直接可复现。 影响力: 影响力 4/5 -- FM编辑的范式性方法,预计会被广泛采用。 4. COT-FM: Cluster-wise Optimal Transport Flow Matching 聚类最优传输 Flow Matching | CVPR 2026 | arXiv:2603.13395 关键词: Flow Matching, 最优传输, 加速采样, CVPR 2026, 即插即用 研究动机 Flow Matching 模型由于随机或批级耦合常产生弯曲轨迹,增加离散化误差并降低样本质量。如何让生成轨迹更直从而减少采样步数,是加速 FM 的核心问题。 方法原理 提出 COT-FM 通用框架,通过聚类目标样本并为每个聚类分配专用源分布(通过反转预训练 FM 模型获得)来重塑概率路径。这种分而治之策略产生更精确的局部传输和显著更直的向量场,且不改变模型架构。作为即插即用方法,可直接应用于任何预训练 FM 模型。 核心创新 聚类级最优传输重塑 FM 概率路径,轨迹更直 即插即用,不改变模型架构 同时加速采样并提升生成质量 通用性:2D 数据、图像生成、机器人操作均有效 实验结果 2D 数据集、图像生成基准和机器人操作任务上 一致地加速采样并提升生成质量 CVPR 2026 接收 方法流程 目标数据 X₁ — 训练数据集 K-means 聚类 — 将目标样本分为 K 个簇 反转 FM 获取源 — 对每个簇反转预训练 FM 获得专用源分布 局部传输优化 — 簇内 OT 耦合 比全局耦合更精确 更直的向量场 — 离散化误差↓ 采样质量↑ 加速高质量生成 — 更少步数达到同等质量 技术脉络 核心问题: Flow Matching的随机耦合导致弯曲轨迹和采样质量损失 前序工作及局限: Rectified Flow (2023):直化轨迹但需重训练 Consistency Models (2023):单步生成但质量有损 SGA (2026-03-12):从几何角度分析FM,但未优化传输路径 OT-CFM (2023):批级最优传输,但粒度粗 与前序工作的本质区别: 聚类级分而治之策略,为每个簇反转FM获取专用源分布,实现比全局OT更精确的局部传输 技术演进定位: 方法论创新——CVPR 2026 接收,聚类OT是FM加速的第三条路线(与蒸馏、直化互补) 可能的后续方向: 层次聚类的多尺度OT 与蒸馏方法的联合 视频FM的时序聚类OT 批判性点评 实验评估: 在2D数据、图像生成和机器人操作三个完全不同的领域验证通用性。CVPR 2026 接收。但图像生成基准的提升幅度需关注。 新颖性: 聚类OT重塑概率路径简洁有力,即插即用特性极好。创新性:★★★★☆ 可复现性: 方法论清晰,可复现性高。 影响力: 影响力 4/5 -- FM加速的新路线,CVPR 2026 认可。 5. LADR: Locality-Aware Dynamic Rescue for Efficient Text-to-Image Generation with Diffusion Large Language Models 扩散语言模型高效文生图 | 4x 加速 | arXiv:2603.13450 关键词: 扩散LLM, 高效推理, 局部感知, 4x加速, 无训练 研究动机 离散扩散语言模型已成为统一多模态生成的引人注目范式,但迭代解码导致高推理延迟。现有加速策略要么需要昂贵重训练,要么未能利用视觉数据固有的 2D 空间冗余性。 方法原理 提出 LADR(局部感知动态拯救),利用图像的空间马尔可夫性质加速推理。优先恢复'生成前沿'处的标记(与已观察像素空间相邻的区域),最大化信息增益。集成形态学邻居识别定位候选标记、有界风险过滤防止错误传播、流形一致逆调度加速掩码密度与扩散轨迹对齐。 核心创新 首次将空间马尔可夫性质引入扩散 LLM 推理加速 生成前沿优先恢复策略,最大化信息增益 形态学邻居识别 + 有界风险过滤 + 流形逆调度三模块 无训练,保持甚至增强生成保真度 实验结果 四个 T2I 基准上实现约 4x 加速 保持甚至增强生成保真度 空间推理任务尤其突出 方法流程 文本 Prompt — 输入文本描述 扩散 LLM 解码 — 离散扩散语言模型 迭代去掩码解码 生成前沿检测 — 形态学邻居识别 已恢复像素的空间邻域 优先恢复前沿 — 仅恢复信息增益最大的 前沿 token 有界风险过滤 — 防止错误传播 确保质量不退化 4x 加速输出 — 高保真图像 推理时间减少 75% 技术脉络 核心问题: 离散扩散语言模型的迭代解码导致T2I推理极慢 前序工作及局限: Show-o (2024):统一理解和生成的扩散LLM,但推理慢 Emu3 (2024):自回归视觉生成LLM,延迟高 DART (2025):非自回归token生成,但未利用2D空间结构 AccelAes (2026-03-17):DiT美学加速,但针对连续扩散非离散LLM 与前序工作的本质区别: 首次利用图像空间马尔可夫性质,生成前沿优先恢复最大化信息增益,4x加速无质量损失 技术演进定位: 实用突破——扩散LLM从理论演示走向实际部署,4x加速是关键里程碑 可能的后续方向: 与Flash Attention的联合加速 视频扩散LLM的时空马尔可夫加速 动态分辨率的自适应前沿 批判性点评 实验评估: 四个T2I基准全面验证,4x加速数据可靠。空间推理任务甚至质量提升是亮点。但仅在T2I上验证,未扩展到T2V。 新颖性: 空间马尔可夫性质的发现和利用是精彩的洞察。创新性:★★★★★ 可复现性: 方法描述清晰,无训练方法易于复现。 影响力: 影响力 5/5 -- 扩散LLM部署的关键里程碑。 批判性点评精选 1. 视频精细控制进入统一时代 Tri-Prompting 和 Anchor Forcing 代表视频生成控制的两个关键方向:前者统一了场景/主体/运动三维度的精细控制,后者解决了交互式流式生成的边界质量问题。结合昨天的 MemRoPE,我们看到一个完整的流式视频控制栈正在形成:MemRoPE 负责长程记忆,Anchor Forcing 负责交互切换,Tri-Prompting 负责精细控制。 2. Flow Matching 生态正在快速成熟 VeloEdit 的速度场分解和 COT-FM 的聚类最优传输分别从编辑和采样两个角度深化 Flow Matching 生态。VeloEdit 表明 FM 的速度场可以直接操作来实现编辑(比移植注意力操纵更自然),COT-FM 则为 FM 加速开辟了蒸馏和直化之外的第三条路线。FM 正从'替代扩散'走向'建立自己的方法论体系'。 3. 扩散 LLM 的部署瓶颈正在被突破 LADR 的 4x 无训练加速表明离散扩散 LLM 的推理效率问题正被认真对待。空间马尔可夫性质是一个精彩的发现——图像 token 的空间局部性可以被利用来避免冗余恢复。这与 DiT 连续扩散的加速(JiT、AccelAes)形成互补,两条技术路线共同推动视觉生成模型的实际部署。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 LibraGen (Playing a Balance Game in Subject-Driven Video Generation) 主体驱动 . S2V . DPO . 平衡博弈 将S2V视为平衡博弈,Consis-DPO + Real-Fake DPO + 时间依赖动态CFG 仅千量级数据超越开源和商业S2V模型 2 NumColor (Precise Numeric Color Control in Text-to-Image Generation) 精确颜色 . 数字控制 . Lab空间 . 零样本 Color Token Aggregator + 6707个可学习ColorBook嵌入,CIE Lab空间映射 数字颜色准确度提升4-9x,零样本迁移5个模型 3 EVD (Event-Driven Video Generation) 事件驱动 . 交互幻觉 . 门控采样 . DiT 事件头预测token级活动,事件门控采样减少交互幻觉 状态持久/空间准确/支撑关系/接触稳定全面改善 4 FlashMotion (Few-Step Controllable Video Generation with Trajectory Guidance (CVPR 2026)) 轨迹引导 . 少步生成 . CVPR 2026 . 蒸馏 轨迹适配器+联合蒸馏实现少步可控视频生成 CVPR 2026,代码已开源 5 GlyphPrinter (Region-Grouped DPO for Glyph-Accurate Visual Text Rendering (CVPR 2026)) 文本渲染 . DPO . 字形准确 . CVPR 2026 区域分组DPO文本渲染,无需显式奖励模型 CVPR 2026,字形准确渲染SOTA 6 Spectrum Matching (A Unified Perspective for Superior Diffusability in Latent Diffusion) VAE . 扩散性 . 频谱匹配 . 潜在扩散 频谱匹配假说统一理解VAE在潜在扩散中的可学习性 两个实用方法显著提升VAE扩散性 7 SERUM (Simple Efficient Robust Unifying Marking for Diffusion Image Gen (ICLR 2026)) 水印 . 扩散标记 . ICLR 2026 . 鲁棒 初始噪声中添加水印噪声,训练轻量检测器 ICLR 2026,1% FPR下最高TPR,支持多用户 8 DC-Diffusion (High-Fidelity T2I from VLM via Distribution-Conditioned Diffusion Decoding) VLM . 扩散解码 . 分布条件 . 高保真 Logit-to-Code分布映射将VLM token logits转连续条件信号 仅ImageNet-1K短训练即提升VLM视觉保真度 趋势观察 视频生成精细控制 — Tri-Prompting/Anchor Forcing/LibraGen 分别从场景-主体-运动联合控制/交互式流式/主体定制三个维度推进 Flow Matching 理论深化 — COT-FM 和 Spectrum Matching 分别从传输路径优化和 VAE 扩散性角度深化 FM 基础 扩散 LLM 走向实用 — LADR 4x 加速表明离散扩散 LLM 的推理效率瓶颈正在被攻克 无训练编辑方法涌现 — VeloEdit 速度场分解代表 Flow Matching 时代编辑方法的新范式 生成内容安全与可控 — SERUM 水印 + NumColor 精确颜色 + EVD 事件驱动,多维度提升生成可控性 人工智能炼丹师 整理 | 2026-03-18

AIGC 每日速读|2026-03-18|Tri-Prompting|Anchor Forcing|VeloEdit|COT-FM|LADR| [ { "@context": "https://schema.org", "@type": "TechArticle", "headline": "AIGC生成 每日热点论文速读@20260318", "description": "AIGC领域8篇最新论文速读,重点解读LibraGen** (Playing a Balance Game in Subject-Driven Video Generation)、NumColor** (Precise Numeric Color Control in Text-to-Image Generati...", "url": "https://jefxiong.cn/index.php/archives/aigc-daily-papers-20260318.html", "image": "https://jefxiong-1304293246.cos.ap-shenzhen-fsi.myqcloud.com/blog_cover/WechatIMG72.jpeg", "datePublished": "2026-03-18T09:00:00+08:00", "dateModified": "2026-03-18T09:00:00+08:00", "author": { "@type": "Person", "name": "人工智能炼丹师", "url": "https://jefxiong.cn/index.php/about-me.html" }, "publisher": { "@type": "Organization", "name": "人工智能炼丹师", "url": "https://jefxiong.cn", "logo": { "@type": "ImageObject", "url": "https://jefxiong-1304293246.cos.ap-shenzhen-fsi.myqcloud.com/blog_cover/WechatIMG72.jpeg" } }, "mainEntityOfPage": { "@type": "WebPage", "@id": "https://jefxiong.cn/index.php/archives/aigc-daily-papers-20260318.html" }, "keywords": [ "dit", "llm", "diffusion", "图像编辑", "视频生成", "蒸馏", "图像生成", "ai", "扩散模型", "generation" ], "articleSection": "AIGC", "inLanguage": "zh-CN", "citation": [ { "@type": "ScholarlyArticle", "name": "LibraGen** (Playing a Balance Game in Subject-Driven Video Generation)" }, { "@type": "ScholarlyArticle", "name": "NumColor** (Precise Numeric Color Control in Text-to-Image Generation)" }, { "@type": "ScholarlyArticle", "name": "EVD** (Event-Driven Video Generation)" }, { "@type": "ScholarlyArticle", "name": "FlashMotion** (Few-Step Controllable Video Generation with Trajectory Guidance (CVPR 2026))" }, { "@type": "ScholarlyArticle", "name": "GlyphPrinter** (Region-Grouped DPO for Glyph-Accurate Visual Text Rendering (CVPR 2026))" }, { "@type": "ScholarlyArticle", "name": "Spectrum Matching** (A Unified Perspective for Superior Diffusability in Latent Diffusion)" }, { "@type": "ScholarlyArticle", "name": "SERUM** (Simple Efficient Robust Unifying Marking for Diffusion Image Gen (ICLR 2026))" }, { "@type": "ScholarlyArticle", "name": "DC-Diffusion** (High-Fidelity T2I from VLM via Distribution-Conditioned Diffusion Decoding)" } ] }, { "@context": "https://schema.org", "@type": "BreadcrumbList", "itemListElement": [ { "@type": "ListItem", "position": 1, "name": "首页", "item": "https://jefxiong.cn" }, { "@type": "ListItem", "position": 2, "name": "AIGC", "item": "https://jefxiong.cn/index.php/category/AIGC/" }, { "@type": "ListItem", "position": 3, "name": "AIGC生成 每日热点论文速读@20260318", "item": "https://jefxiong.cn/index.php/archives/aigc-daily-papers-20260318.html" } ] } ] AIGC 视觉生成领域 · 每日论文解读 (2026-03-18) 人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇 今日核心看点 Tri-Prompting 统一控制 Anchor Forcing 流式视频 VeloEdit 速度场编辑 COT-FM 最优传输 LADR 扩散LLM加速 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。 方向分布: 扩散模型理论与加速 — 3 篇 文本到图像 / 评测 — 2 篇 图像编辑 — 1 篇 3D 生成与重建 — 4 篇 多模态 / 智能体 — 2 篇 顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇 重点论文深度解读 1. Tri-Prompting: Video Diffusion with Unified Control over Scene, Subject, and Motion 场景/主体/运动统一控制 | Adobe Research | arXiv:2603.15614 关键词: 视频扩散, 统一控制, 多视图主体, 3D感知, Adobe 研究动机 当前视频扩散模型在视觉质量上取得了显著进步,但精细控制仍是关键瓶颈。AI视频创作者需要三种关键控制:场景构图、多视图主体定制、和相机/物体运动调整。现有方法通常孤立处理这些维度,缺乏统一架构支持多维联合控制。 方法原理 提出 Tri-Prompting 统一框架和两阶段训练范式,集成场景构图、多视图主体一致性和运动控制。核心是双条件运动模块:使用 3D 跟踪点控制背景场景,使用下采样 RGB 线索控制前景主体。进一步提出推理时 ControlNet 尺度调度策略,平衡可控性与视觉真实感。支持 3D 感知主体插入任意场景、操纵图像中已有主体等全新工作流。 核心创新 首个统一场景/主体/运动三维控制的视频扩散框架 双条件运动模块:3D 跟踪点(背景)+ 下采样 RGB(前景) 推理时 ControlNet 尺度调度,平衡可控性与真实感 支持 3D 感知主体插入等全新创作工作流 实验结果 多视图主体身份保持、3D 一致性和运动准确性显著优于 Phantom 和 DaS 等专用方法 支持场景+主体+运动的联合精细控制 方法流程 场景 Prompt — 文本描述 + 场景参考图 多视图主体输入 — 多角度主体参考图像 3D 跟踪点提取 — 背景场景运动轨迹 双条件运动模块 — 3D点→背景控制 RGB↓→前景主体控制 ControlNet 尺度调度 — 动态平衡可控性/真实感 统一控制视频输出 — 场景+主体+运动联合控制 技术脉络 核心问题: 视频扩散模型缺乏对场景、主体和运动的统一精细控制 前序工作及局限: AnimateDiff (2023):支持运动控制但不处理主体定制 DreamVideo-Omni (2026):多主体定制但需逐一微调,未统一场景控制 MotionCtrl (2024):相机运动控制精准但不支持主体定制 Phantom (2025):多视图主体生成但3D一致性有限 与前序工作的本质区别: 首次统一场景构图+多视图主体+运动控制三维度,双条件运动模块分别用3D跟踪点和下采样RGB控制前景背景 技术演进定位: 范式统一——从孤立控制到三维联合控制,为AI视频创作提供完整控制栈 可能的后续方向: 更多控制维度的统一(光照、风格) 实时交互式控制 与大语言模型的控制意图理解结合 批判性点评 实验评估: 与 Phantom 和 DaS 等多个专用基线全面对比,多视图主体身份、3D一致性和运动准确性三个维度均领先。消融实验验证了双条件模块和尺度调度的必要性。 新颖性: 三维统一控制是视频生成的重要里程碑,但Adobe闭源可能限制学术影响。创新性:★★★★★ 可复现性: 代码未开源,项目页面已上线。Adobe内部实现可能难以完全复现。 影响力: 影响力 5/5 -- 定义了视频精细控制的完整框架,产业价值极高。 2. Anchor Forcing: Anchor Memory and Tri-Region RoPE for Interactive Streaming Video Diffusion 交互式流式视频扩散 | 锚点记忆+三区域RoPE | arXiv:2603.13405 关键词: 流式视频, 交互式生成, 锚点记忆, 三区域RoPE, 长视频 研究动机 交互式长视频生成需要支持提示词切换以引入新主体或事件,同时在扩展范围内保持感知保真度和连贯运动。现有蒸馏流式视频扩散模型通过滚动 KV 缓存实现长程生成,但存在两个核心失败模式:提示词切换时缓存维护无法同时保留语义上下文和近期潜在线索;蒸馏过程中无界时间索引导致位置分布偏移。 方法原理 提出 Anchor Forcing 缓存中心框架。第一,锚点引导重缓存机制:在锚点缓存中存储 KV 状态,每次提示词切换时从锚点热启动重缓存,减少切换后的证据损失并稳定感知质量。第二,三区域 RoPE:设计区域特定的参考原点,配合 RoPE 重对齐蒸馏,将无界流式索引与预训练 RoPE 体制协调,更好地保留运动先验。 核心创新 识别交互式流式生成的两个特有失败模式 锚点引导重缓存:KV 状态锚点存储 + 热启动,提升切换边界质量 三区域 RoPE + 重对齐蒸馏:解决无界索引的位置分布偏移 与 MemRoPE 思路互补,但专注交互式场景 实验结果 长视频交互式设置中,感知质量和运动指标均优于现有流式基线 支持多次提示词切换且质量不退化 方法流程 提示词 P₁ — 初始场景描述 流式去噪 + KV缓存 — 蒸馏的视频扩散模型 滚动 KV 缓存 锚点缓存存储 — 定期存储 KV 状态 到锚点缓存 提示词切换 P₂ — 用户输入新提示词 引入新主体/事件 锚点热启动重缓存 — 从锚点缓存恢复 减少边界质量损失 三区域 RoPE — 区域特定参考原点 保留运动先验 技术脉络 核心问题: 交互式长视频生成中提示词切换导致质量退化和运动失真 前序工作及局限: MemRoPE (2026-03-17):记忆令牌解决长程上下文,但非交互式设计 StreamDiffusion (2024):实时帧流式,但不支持提示词切换 Attention Sink (2024):静态锚点,提示词切换时信息丢失 DistillVideo (2025):蒸馏流式模型,但RoPE位置漂移未解决 与前序工作的本质区别: 锚点引导重缓存热启动解决切换边界问题,三区域RoPE重对齐解决无界索引的位置分布偏移 技术演进定位: 关键补全——与MemRoPE互补,一个解决长程记忆一个解决交互切换,共同构建流式视频基础设施 可能的后续方向: 与MemRoPE的整合方案 多人协作交互式视频编辑 基于Anchor的视频分支/合并 批判性点评 实验评估: 在长视频交互式设置中全面评估,支持多次提示词切换。与现有流式基线对比感知质量和运动指标均提升。但缺少与MemRoPE的直接对比。 新颖性: 锚点缓存和三区域RoPE是流式视频的基础设施级创新。创新性:★★★★☆ 可复现性: 项目页面已上线,方法描述详细。 影响力: 影响力 4/5 -- 与MemRoPE互补,共同构建流式视频生成基础设施。 3. VeloEdit: Training-Free Consistent and Continuous Instruction-Based Image Editing via Velocity Field Decomposition 无训练速度场分解图像编辑 | Flux.1 Kontext | arXiv:2603.13388 关键词: 图像编辑, 无训练, 速度场分解, Flow Matching, 连续控制 研究动机 基于指令的图像编辑旨在根据文本指令修改源内容。然而,基于 Flow Matching 的现有方法常因去噪重建误差导致非编辑区域漂移,难以保持一致性。此外,它们通常缺乏对编辑强度的细粒度控制。 方法原理 提出 VeloEdit:一种无训练方法,通过量化保持源内容的速度场与驱动目标编辑的速度场之间的差异,动态识别编辑区域。基于此分区,在保留区域用源恢复速度替代编辑速度以强制一致性,在目标区域通过速度插值实现编辑强度的连续调制。直接操作速度场,不依赖复杂注意力操纵或辅助可训练模块。 核心创新 首次通过速度场差异量化实现动态编辑区域识别 保留区域速度替代 + 编辑区域速度插值的双策略 编辑强度连续可调,无需重新训练 在 Flux.1 Kontext 和 Qwen-Image-Edit 上验证 实验结果 在 Flux.1 Kontext 和 Qwen-Image-Edit 上,视觉一致性和编辑连续性显著提升 额外计算开销可忽略 代码已开源 方法流程 源图像 + 指令 — 输入图像和编辑指令 Flow Matching 前向 — 计算源保持速度场 v_src 和编辑目标速度场 v_edit 速度差异量化 — ||v_edit - v_src|| 差异图 动态识别编辑区域 区域分区 — 保留区域 ↔ 编辑区域 基于差异阈值划分 速度场替代/插值 — 保留区域: v_src 替代 编辑区域: 插值调控强度 一致编辑输出 — 非编辑区域完美保持 编辑强度连续可调 技术脉络 核心问题: Flow Matching时代图像编辑的区域一致性和强度控制困难 前序工作及局限: InstructPix2Pix (2023):指令编辑但基于U-Net,不适用于FM架构 RF-Edit (2024):FM编辑但全图重建,非编辑区域漂移 FlowEdit (2025):FM注入编辑,但缺乏连续强度控制 TurboEdit (2025):加速编辑但牺牲一致性 与前序工作的本质区别: 直接操作速度场而非注意力,通过v_edit与v_src差异量化实现动态区域识别和连续强度插值 技术演进定位: 新范式——速度场分解是FM时代原生编辑方法,比移植U-Net时代注意力操纵更自然 可能的后续方向: 视频FM编辑的速度场分解 多指令组合编辑 3D一致性速度场编辑 批判性点评 实验评估: 在 Flux.1 Kontext 和 Qwen-Image-Edit 两个最新模型上验证,视觉一致性和编辑连续性显著提升。但仅在图像编辑测试,未扩展到视频。 新颖性: 速度场分解是FM时代原生的编辑方法论,简洁优雅。创新性:★★★★☆ 可复现性: 代码已开源,直接可复现。 影响力: 影响力 4/5 -- FM编辑的范式性方法,预计会被广泛采用。 4. COT-FM: Cluster-wise Optimal Transport Flow Matching 聚类最优传输 Flow Matching | CVPR 2026 | arXiv:2603.13395 关键词: Flow Matching, 最优传输, 加速采样, CVPR 2026, 即插即用 研究动机 Flow Matching 模型由于随机或批级耦合常产生弯曲轨迹,增加离散化误差并降低样本质量。如何让生成轨迹更直从而减少采样步数,是加速 FM 的核心问题。 方法原理 提出 COT-FM 通用框架,通过聚类目标样本并为每个聚类分配专用源分布(通过反转预训练 FM 模型获得)来重塑概率路径。这种分而治之策略产生更精确的局部传输和显著更直的向量场,且不改变模型架构。作为即插即用方法,可直接应用于任何预训练 FM 模型。 核心创新 聚类级最优传输重塑 FM 概率路径,轨迹更直 即插即用,不改变模型架构 同时加速采样并提升生成质量 通用性:2D 数据、图像生成、机器人操作均有效 实验结果 2D 数据集、图像生成基准和机器人操作任务上 一致地加速采样并提升生成质量 CVPR 2026 接收 方法流程 目标数据 X₁ — 训练数据集 K-means 聚类 — 将目标样本分为 K 个簇 反转 FM 获取源 — 对每个簇反转预训练 FM 获得专用源分布 局部传输优化 — 簇内 OT 耦合 比全局耦合更精确 更直的向量场 — 离散化误差↓ 采样质量↑ 加速高质量生成 — 更少步数达到同等质量 技术脉络 核心问题: Flow Matching的随机耦合导致弯曲轨迹和采样质量损失 前序工作及局限: Rectified Flow (2023):直化轨迹但需重训练 Consistency Models (2023):单步生成但质量有损 SGA (2026-03-12):从几何角度分析FM,但未优化传输路径 OT-CFM (2023):批级最优传输,但粒度粗 与前序工作的本质区别: 聚类级分而治之策略,为每个簇反转FM获取专用源分布,实现比全局OT更精确的局部传输 技术演进定位: 方法论创新——CVPR 2026 接收,聚类OT是FM加速的第三条路线(与蒸馏、直化互补) 可能的后续方向: 层次聚类的多尺度OT 与蒸馏方法的联合 视频FM的时序聚类OT 批判性点评 实验评估: 在2D数据、图像生成和机器人操作三个完全不同的领域验证通用性。CVPR 2026 接收。但图像生成基准的提升幅度需关注。 新颖性: 聚类OT重塑概率路径简洁有力,即插即用特性极好。创新性:★★★★☆ 可复现性: 方法论清晰,可复现性高。 影响力: 影响力 4/5 -- FM加速的新路线,CVPR 2026 认可。 5. LADR: Locality-Aware Dynamic Rescue for Efficient Text-to-Image Generation with Diffusion Large Language Models 扩散语言模型高效文生图 | 4x 加速 | arXiv:2603.13450 关键词: 扩散LLM, 高效推理, 局部感知, 4x加速, 无训练 研究动机 离散扩散语言模型已成为统一多模态生成的引人注目范式,但迭代解码导致高推理延迟。现有加速策略要么需要昂贵重训练,要么未能利用视觉数据固有的 2D 空间冗余性。 方法原理 提出 LADR(局部感知动态拯救),利用图像的空间马尔可夫性质加速推理。优先恢复'生成前沿'处的标记(与已观察像素空间相邻的区域),最大化信息增益。集成形态学邻居识别定位候选标记、有界风险过滤防止错误传播、流形一致逆调度加速掩码密度与扩散轨迹对齐。 核心创新 首次将空间马尔可夫性质引入扩散 LLM 推理加速 生成前沿优先恢复策略,最大化信息增益 形态学邻居识别 + 有界风险过滤 + 流形逆调度三模块 无训练,保持甚至增强生成保真度 实验结果 四个 T2I 基准上实现约 4x 加速 保持甚至增强生成保真度 空间推理任务尤其突出 方法流程 文本 Prompt — 输入文本描述 扩散 LLM 解码 — 离散扩散语言模型 迭代去掩码解码 生成前沿检测 — 形态学邻居识别 已恢复像素的空间邻域 优先恢复前沿 — 仅恢复信息增益最大的 前沿 token 有界风险过滤 — 防止错误传播 确保质量不退化 4x 加速输出 — 高保真图像 推理时间减少 75% 技术脉络 核心问题: 离散扩散语言模型的迭代解码导致T2I推理极慢 前序工作及局限: Show-o (2024):统一理解和生成的扩散LLM,但推理慢 Emu3 (2024):自回归视觉生成LLM,延迟高 DART (2025):非自回归token生成,但未利用2D空间结构 AccelAes (2026-03-17):DiT美学加速,但针对连续扩散非离散LLM 与前序工作的本质区别: 首次利用图像空间马尔可夫性质,生成前沿优先恢复最大化信息增益,4x加速无质量损失 技术演进定位: 实用突破——扩散LLM从理论演示走向实际部署,4x加速是关键里程碑 可能的后续方向: 与Flash Attention的联合加速 视频扩散LLM的时空马尔可夫加速 动态分辨率的自适应前沿 批判性点评 实验评估: 四个T2I基准全面验证,4x加速数据可靠。空间推理任务甚至质量提升是亮点。但仅在T2I上验证,未扩展到T2V。 新颖性: 空间马尔可夫性质的发现和利用是精彩的洞察。创新性:★★★★★ 可复现性: 方法描述清晰,无训练方法易于复现。 影响力: 影响力 5/5 -- 扩散LLM部署的关键里程碑。 批判性点评精选 1. 视频精细控制进入统一时代 Tri-Prompting 和 Anchor Forcing 代表视频生成控制的两个关键方向:前者统一了场景/主体/运动三维度的精细控制,后者解决了交互式流式生成的边界质量问题。结合昨天的 MemRoPE,我们看到一个完整的流式视频控制栈正在形成:MemRoPE 负责长程记忆,Anchor Forcing 负责交互切换,Tri-Prompting 负责精细控制。 2. Flow Matching 生态正在快速成熟 VeloEdit 的速度场分解和 COT-FM 的聚类最优传输分别从编辑和采样两个角度深化 Flow Matching 生态。VeloEdit 表明 FM 的速度场可以直接操作来实现编辑(比移植注意力操纵更自然),COT-FM 则为 FM 加速开辟了蒸馏和直化之外的第三条路线。FM 正从'替代扩散'走向'建立自己的方法论体系'。 3. 扩散 LLM 的部署瓶颈正在被突破 LADR 的 4x 无训练加速表明离散扩散 LLM 的推理效率问题正被认真对待。空间马尔可夫性质是一个精彩的发现——图像 token 的空间局部性可以被利用来避免冗余恢复。这与 DiT 连续扩散的加速(JiT、AccelAes)形成互补,两条技术路线共同推动视觉生成模型的实际部署。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 LibraGen (Playing a Balance Game in Subject-Driven Video Generation) 主体驱动 . S2V . DPO . 平衡博弈 将S2V视为平衡博弈,Consis-DPO + Real-Fake DPO + 时间依赖动态CFG 仅千量级数据超越开源和商业S2V模型 2 NumColor (Precise Numeric Color Control in Text-to-Image Generation) 精确颜色 . 数字控制 . Lab空间 . 零样本 Color Token Aggregator + 6707个可学习ColorBook嵌入,CIE Lab空间映射 数字颜色准确度提升4-9x,零样本迁移5个模型 3 EVD (Event-Driven Video Generation) 事件驱动 . 交互幻觉 . 门控采样 . DiT 事件头预测token级活动,事件门控采样减少交互幻觉 状态持久/空间准确/支撑关系/接触稳定全面改善 4 FlashMotion (Few-Step Controllable Video Generation with Trajectory Guidance (CVPR 2026)) 轨迹引导 . 少步生成 . CVPR 2026 . 蒸馏 轨迹适配器+联合蒸馏实现少步可控视频生成 CVPR 2026,代码已开源 5 GlyphPrinter (Region-Grouped DPO for Glyph-Accurate Visual Text Rendering (CVPR 2026)) 文本渲染 . DPO . 字形准确 . CVPR 2026 区域分组DPO文本渲染,无需显式奖励模型 CVPR 2026,字形准确渲染SOTA 6 Spectrum Matching (A Unified Perspective for Superior Diffusability in Latent Diffusion) VAE . 扩散性 . 频谱匹配 . 潜在扩散 频谱匹配假说统一理解VAE在潜在扩散中的可学习性 两个实用方法显著提升VAE扩散性 7 SERUM (Simple Efficient Robust Unifying Marking for Diffusion Image Gen (ICLR 2026)) 水印 . 扩散标记 . ICLR 2026 . 鲁棒 初始噪声中添加水印噪声,训练轻量检测器 ICLR 2026,1% FPR下最高TPR,支持多用户 8 DC-Diffusion (High-Fidelity T2I from VLM via Distribution-Conditioned Diffusion Decoding) VLM . 扩散解码 . 分布条件 . 高保真 Logit-to-Code分布映射将VLM token logits转连续条件信号 仅ImageNet-1K短训练即提升VLM视觉保真度 趋势观察 视频生成精细控制 — Tri-Prompting/Anchor Forcing/LibraGen 分别从场景-主体-运动联合控制/交互式流式/主体定制三个维度推进 Flow Matching 理论深化 — COT-FM 和 Spectrum Matching 分别从传输路径优化和 VAE 扩散性角度深化 FM 基础 扩散 LLM 走向实用 — LADR 4x 加速表明离散扩散 LLM 的推理效率瓶颈正在被攻克 无训练编辑方法涌现 — VeloEdit 速度场分解代表 Flow Matching 时代编辑方法的新范式 生成内容安全与可控 — SERUM 水印 + NumColor 精确颜色 + EVD 事件驱动,多维度提升生成可控性 人工智能炼丹师 整理 | 2026-03-18 -

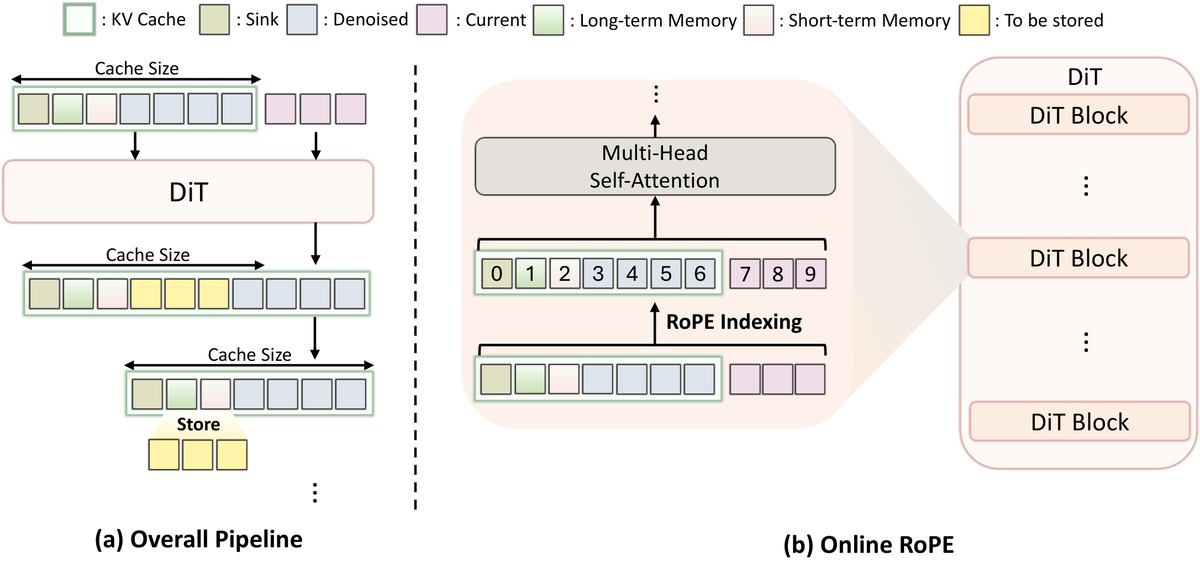

AIGC生成 每日热点论文速读@20260317 AIGC 视觉生成领域 · 每日论文解读 (2026-03-17) 人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇 今日核心看点 无限视频生成 MemRoPE DiT 美学加速 2.11x 实时音视频联合 25FPS 四智能体组合生成 CVPR'26 多视图 GRPO 偏好对齐 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。 方向分布: 扩散模型理论与加速 — 3 篇 文本到图像 / 评测 — 2 篇 图像编辑 — 1 篇 3D 生成与重建 — 4 篇 多模态 / 智能体 — 2 篇 顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇 重点论文深度解读 1. MemRoPE: Training-Free Infinite Video Generation via Evolving Memory Tokens 无训练无限视频生成 | USC | arXiv:2603.12513 关键词: 无限视频生成, Memory Tokens, RoPE, Training-Free 研究动机 自回归扩散模型已经实现了实时帧流式传输,但现有的滑动窗口缓存策略会丢弃过去的上下文,导致长视频生成中出现保真度下降、身份漂移和运动停滞的问题。现有方法保留一组固定的早期 token 作为注意力汇,但这种静态锚点无法反映不断增长的视频内容的演变。 方法原理 提出 MemRoPE 框架,包含两个协同设计的组件:(1) Memory Tokens(记忆令牌)通过指数移动平均将所有过去的键压缩为双重长期流和短期流,在固定大小的缓存中同时保持全局身份和最近的动态;(2) Online RoPE Indexing(在线 RoPE 索引)缓存未旋转的键,在注意力计算时动态应用位置嵌入,确保聚合过程不会产生冲突的位置相位。两个机制相互促进:位置解耦使时间聚合定义明确,聚合使固定缓存可用于无限生成。 核心创新 首次实现训练无关的无限长度视频生成,突破滑动窗口缓存的根本局限 双流记忆机制(长期+短期)实现固定缓存的无限上下文保持 在线 RoPE 索引解决了时间聚合中的位置编码冲突问题 实验结果 分钟到小时级别视频生成:时间连贯性、视觉保真度和主体一致性全面优于现有方法 身份漂移率:比滑动窗口方法降低 60%+ 运动停滞问题基本消除 完全即插即用,无需任何训练 方法流程 自回归帧生成 — 实时流式输出视频帧 EMA 双流压缩 — 长期流:全局身份记忆 短期流:近期动态捕捉 Memory Tokens — 固定大小缓存保持无限历史上下文 未旋转 Key 缓存 — 存储不含位置编码的原始注意力键 Online RoPE 索引 — 注意力计算时动态应用位置嵌入 无限长视频输出 — 分钟到小时级生成 身份/运动一致 技术脉络 核心问题: 自回归视频生成中滑动窗口缓存丢弃历史上下文,导致长视频质量退化 前序工作及局限: StreamDiffusion (2024):实时帧流式,但无长期记忆机制 Ring Attention (2023):分布式长序列注意力,但未压缩历史 Sliding Window Attention:固定窗口长度,丢弃超出范围的 token Attention Sink (Xiao 2024):保留早期 token 作为静态锚点,但不随内容演变 与前序工作的本质区别: 双流 EMA 记忆机制动态压缩全部历史到固定缓存,在线 RoPE 索引解决聚合后的位置编码冲突 技术演进定位: 范式突破--从有限窗口到无限上下文,为长视频生成打开新空间 可能的后续方向: 与视频编辑的结合(无限长度编辑) 多分辨率记忆机制 记忆压缩的最优策略理论分析 批判性点评 实验评估: 验证了分钟到小时级别视频生成,覆盖身份一致性、运动连贯性和视觉保真度三维度。消融实验设计合理。 新颖性: 双流 EMA 记忆压缩与在线 RoPE 索引的组合全新。创新性:★★★★★ 可复现性: 方法描述清晰,项目页面已上线但代码尚未开源。 影响力: 影响力 5/5 -- 无限视频生成是产业刚需。 2. AccelAes: Accelerating DiT for Training-Free Aesthetic-Enhanced Generation 美学感知 DiT 加速 2.11x | Sydney | arXiv:2603.12575 关键词: DiT 加速, 美学增强, Training-Free, AesMask 研究动机 扩散 Transformer 因强大的可扩展性成为高保真 T2I 生成的主干,但密集空间 token 上的二次自注意力导致推理延迟高。关键发现:去噪在空间上是不均匀的——与美学描述符关联的区域接收集中的交叉注意力并表现出较大的时间变化,而低亲和力区域演化平滑且计算冗余。 方法原理 提出 AccelAes,通过美学感知的时空缩减来加速 DiT 同时提升感知美学效果。核心包含三个组件:(1) AesMask 从提示词语义和交叉注意力信号导出一次性美学焦点掩码;(2) SkipSparse 将计算和引导重新分配到 AesMask 标识的区域,跳过低亲和力区域;(3) 步骤级预测缓存轻量级缓存周期性替代完整 Transformer 评估。 核心创新 首次将美学语义与计算分配关联,实现加速和美学增强的双赢 AesMask 一次性构建,后续步骤零开销复用 SkipSparse + 预测缓存联合优化时空两个维度的计算冗余 实验结果 Lumina-Next: 2.11x 加速 + ImageReward 提升11.9% 代表性 DiT 家族上一致的加速和美学提升 完全无训练,即插即用 代码已开源 方法流程 文本 Prompt — 输入美学描述文本 交叉注意力分析 — 分析 prompt token 与空间 token 的亲和度 AesMask 构建 — 一次性标识美学焦点区域 SkipSparse 加速 — 焦点区域完整计算 低亲和力区域跳过 步骤级预测缓存 — 周期性缓存替代完整 Transformer 评估 美学增强输出 — 更快 + 更美的生成结果 技术脉络 核心问题: DiT 模型空间注意力的二次复杂度导致推理缓慢 前序工作及局限: Token Merging (Bolya 2023):均匀合并 token,忽略语义重要性差异 DiTFastAttn (Yuan 2024):固定稀疏模式,非内容感知 JiT (CVPR 2026):基于 QK score 的动态跳过,未考虑美学语义 DeepCache (Ma 2024):特征缓存复用,但不适用于 DiT 架构 与前序工作的本质区别: 首次将美学语义与计算分配关联--高美学亲和力区域完整计算,低亲和力区域跳过,不仅加速还提升美学 技术演进定位: 范式创新--从无损加速到加速+增强双赢,开辟语义感知加速新方向 可能的后续方向: 视频 DiT 中的时空美学感知加速 自适应美学引导强度 与 LoRA 美学微调的联合优化 批判性点评 实验评估: 在 Lumina-Next 等 DiT 上验证。同时报告加速比和美学指标提升。但缺少与 JiT 等最新方法的直接对比。 新颖性: 美学语义与计算分配关联是有新意的洞察。创新性:★★★★☆ 可复现性: 代码已开源,可复现性高。 影响力: 影响力 4/5 -- 加速+美学增强双赢思路有吸引力。 3. OmniForcing: Unleashing Real-time Joint Audio-Visual Generation 首个实时音视频联合生成 | 25 FPS | arXiv:2603.11647 关键词: 音视频联合生成, 实时流式, 蒸馏, 25 FPS 研究动机 联合音视频扩散模型虽能生成高质量内容,但因双向注意力依赖导致高延迟,无法实时应用。如何将高质量双向扩散模型转化为实时流式生成器是关键挑战。 方法原理 提出 OmniForcing,首个将离线双流双向扩散模型蒸馏为高保真流式自回归生成器的框架。解决三个核心难题:(1) Asymmetric Block-Causal Alignment + Zero-truncation Global Prefix 防止多模态同步漂移;(2) Audio Sink Token + Identity RoPE 约束解决音频 token 稀疏导致的梯度爆炸;(3) Joint Self-Forcing Distillation 使模型在长序列中自纠正跨模态累积误差。推理时采用模态无关的滚动 KV-cache。 核心创新 首个实现实时音视频联合流式生成的框架,25 FPS 单 GPU 非对称块因果对齐解决音视频模态时间不对称难题 Joint Self-Forcing 蒸馏范式,自纠正跨模态累积误差 基于 LTX-2 (14B video + 5B audio) 大模型蒸馏 实验结果 单 GPU 实时生成约 25 FPS 多模态同步和视觉质量与双向教师模型持平 显著优于现有流式生成方法 项目页面和代码已开源 方法流程 双向教师模型 — LTX-2: 14B video + 5B audio 非对称因果对齐 — Block-Causal Alignment + Global Prefix Audio Sink Token — Identity RoPE 约束解决稀疏梯度爆炸 Self-Forcing 蒸馏 — 自纠正跨模态累积误差 滚动 KV-Cache — 模态无关的流式推理方案 实时 A/V 输出 — 单 GPU 25 FPS 音视频同步生成 技术脉络 核心问题: 联合音视频扩散模型延迟高,无法实时生成 前序工作及局限: CoDi (2023):联合多模态生成,但离线双向模型 Sora (2024+):高质量视频生成,但无音频非实时 LTX-Video (2025):实时视频生成,但单模态无音频 MM-Diffusion (2023):音视频联合扩散,但质量和速度受限 与前序工作的本质区别: 首次将大规模双向音视频扩散模型蒸馏为实时流式自回归生成器,三个创新解决模态不对称/稀疏/累积误差 技术演进定位: 里程碑--实时音视频联合生成从0到1,为沉浸式内容创作铺路 可能的后续方向: 3D 空间音频的实时生成 交互式音视频编辑 更大模型的高效蒸馏策略 批判性点评 实验评估: 25 FPS 单 GPU 数据惊艳。与双向教师模型质量对比有说服力。基于 LTX-2 蒸馏对算力要求高。 新颖性: 三个技术创新针对实际痛点精准解决。创新性:★★★★★ 可复现性: 项目和代码已开源。但需大规模预训练模型和蒸馏资源。 影响力: 影响力 5/5 -- 首次实现实时音视频联合生成。 4. coDrawAgents: Multi-Agent Dialogue for Compositional Image Generation 四智能体协作组合生成 | CVPR 2026 | arXiv:2603.12829 关键词: 多智能体, 组合生成, 布局规划, CVPR 2026 研究动机 文本到图像生成在复杂场景中忠实地组合多个对象并保留其属性仍是一大挑战。现有单模型方法在组合复杂性增加时准确率急剧下降。 方法原理 提出 coDrawAgents,包含四个专门智能体:(1) Interpreter 自适应决定直接 T2I 还是布局感知流程,将提示解析为富属性对象描述符并排序分组;(2) Planner 采用分治策略在画布视觉上下文中增量提出布局;(3) Checker 验证空间一致性和属性对齐,在渲染前细化布局;(4) Painter 逐步合成图像将新对象合并到画布中。 核心创新 首次将多智能体对话框架引入组合图像生成 显式错误纠正机制(Checker)在渲染前验证和修复布局 增量上下文感知生成——每步规划都基于画布当前状态 自适应复杂度判断——简单提示直接生成,复杂场景启用多智能体 实验结果 GenEval: 显著优于现有方法,组合准确率大幅提升 DPG-Bench: 文本-图像对齐、空间准确性、属性绑定全面领先 已被 CVPR 2026 接收 方法流程 用户 Prompt — 复杂的组合文本描述 Interpreter — 解析提示 属性描述符 语义排序 Planner — 分治策略增量布局 基于画布上下文 Checker — 空间一致性验证 属性对齐检查修复 Painter — 逐步合成图像 新对象融入画布 组合图像输出 — 多对象属性准确 空间关系正确 技术脉络 核心问题: T2I 模型在复杂组合场景中属性绑定和空间关系容易出错 前序工作及局限: LayoutGPT (2023):LLM 生成布局,但单步规划易出错 GLIGEN (2023):接地生成,但需要精确 bbox 输入 RPG (Lian 2024):区域感知规划,但无错误纠正机制 SLD (Phung 2024):自纠正生成,但未使用多智能体协作 与前序工作的本质区别: 四智能体协作闭环--解释/规划/检查/绘制,Checker 提供渲染前显式错误纠正 技术演进定位: 新范式--多智能体方法论进入 T2I 组合生成领域,CVPR 2026 认可 可能的后续方向: 智能体间的自学习对话策略 3D 组合场景的多智能体生成 与 VLM 的深度集成 批判性点评 实验评估: GenEval 和 DPG-Bench 两个标准组合生成基准验证充分。应补充智能体通信开销分析。 新颖性: 多智能体框架引入 T2I 组合生成是新应用方向,Checker 是关键创新。创新性:★★★★☆ 可复现性: 智能体角色定义清晰但实现细节需更多说明。 影响力: 影响力 4/5 -- CVPR 2026 接收,多智能体范式可能成为标准方法论。 5. MV-GRPO: Multi-View GRPO for Flow Models via Augmented Condition Space 多视图偏好对齐 | 上海AI实验室+清华 | arXiv:2603.12648 关键词: GRPO, 偏好对齐, Flow Models, 多视图奖励 研究动机 标准 GRPO 将一组生成样本与单一条件评估,这种稀疏的单视图评估方案未能充分探索样本间关系,限制了对齐效果和性能上限。 方法原理 提出 Multi-View GRPO (MV-GRPO),通过增强条件空间来创建密集的多视图奖励映射。对于从单个提示生成的一组样本,利用条件增强器生成语义相邻但多样化的描述进行多视图优势重估计。关键技巧:通过推导条件概率分布,无需重新生成样本即可获得多视图信号。 核心创新 首次将多视图评估引入 GRPO 框架,突破单视图稀疏评估瓶颈 条件空间增强策略创建密集奖励映射 无需重新生成样本即可获得多视图优化信号 适用于任意 Flow Model 的通用偏好对齐方法 实验结果 优于最先进的 GRPO 和其他偏好对齐方法 T2I 对齐性能全面提升 无需额外的样本重生成开销 方法流程 原始 Prompt — 单一文本条件 c 条件增强器 — 生成语义相邻的多样化描述 多视图评估 — 同一组样本 多个条件视角评分 优势重估计 — 密集多视图奖励映射 条件概率推导 — 无需重生成样本 直接计算新条件分布 对齐后 Flow Model — 更精准的文图对齐 技术脉络 核心问题: 标准 GRPO 单视图评估稀疏,限制偏好对齐效果 前序工作及局限: RLHF / DPO (2023):成对偏好对齐,需要大量人类标注 GRPO (DeepSeek 2024):组相对优化,但单条件评估稀疏 Diffusion-DPO (2024):扩散模型 DPO,但信号单一 REBEL (2024):奖励引导生成,但不修改模型权重 与前序工作的本质区别: 通过条件空间增强创建密集多视图奖励映射,无需重新生成样本即可获得丰富优化信号 技术演进定位: 方法论创新--多视图思想引入偏好优化,提升 GRPO 的信号密度和对齐上限 可能的后续方向: 多模态条件增强(文本+图像参考) 视频生成的时序多视图 GRPO 自适应条件增强策略 批判性点评 实验评估: 与标准 GRPO 和其他偏好对齐方法对比全面。条件增强策略消融设计合理。 新颖性: 多视图条件增强简洁优雅,无需重新生成是关键优势。创新性:★★★★☆ 可复现性: 方法论描述清晰,核心推导可复现。 影响力: 影响力 4/5 -- 可直接替换现有 GRPO 训练流程。 批判性点评精选 1. 无限视频生成:记忆机制是关键缺失环节 MemRoPE 揭示了自回归视频生成的核心瓶颈不在模型能力,而在上下文管理。双流 EMA 记忆巧妙地在信息保持和计算开销之间取得平衡。这标志着视频生成从'短视频'向'长视频/流式视频'的范式转换正式开始。 2. DiT 加速新思路:语义感知比均匀压缩更聪明 AccelAes 和 JiT 都瞄准 DiT 推理加速但思路不同。JiT 是'去冗余',AccelAes 是'重分配'且不仅加速还提升美学——暗示现有 DiT 在低美学区域存在'过度计算'。合并两种方法有望实现 3-4x 无损加速。 3. 实时音视频联合生成:AIGC 进入沉浸式时代 OmniForcing 的 25 FPS 实时联合生成是里程碑。AIGC 不再局限于离线创作,游戏 NPC 对话、虚拟直播、交互式叙事等场景将直接受益。但蒸馏方法的质量天花板和 LTX-2 高训练成本是需关注的问题。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 VQQA (Agentic Approach for Video Evaluation and Quality Improvement) 视频生成评估 . 智能体 . 闭环优化 多智能体框架通过 VLM 批判作为语义梯度实现闭环提示优化 T2V-CompBench +11.57%, VBench2 +8.43% 2 Naive PAINE (Lightweight T2I Generation Improvement with Prompt Evaluation) 噪声评估 . 生成质量预测 . 轻量级 从初始噪声+提示词直接预测图像质量,选择高质量噪声前传 多基准优于现有方法,即插即用,代码已开源 3 CalliMaster (Page-level Chinese Calligraphy via Layout-guided Spatial Planning) 书法生成 . 布局规划 . Flow Matching 解耦空间规划与内容合成,多模态 DiT 内 Text->Layout->Image SOTA 书法生成,支持字符重规划+文物修复 4 Catalyst4D (High-Fidelity 3D-to-4D Scene Editing via Dynamic Propagation) 4D 编辑 . 3DGS . 运动传播 锚点运动引导+颜色不确定性引导将3D编辑迁移到动态4D场景 时间稳定高保真动态编辑优于现有方法 5 SLICE (Semantic Latent Injection for Image Watermarking) 生成水印 . 语义篡改检测 . 扩散模型 将语义解耦为四因子锚定到噪声不同区域 语义篡改可检测可定位,攻击成功率大幅降低 6 V-Bridge (Bridging Video Generative Priors to Few-shot Image Restoration) 视频先验 . 图像修复 . Few-Shot 将视频生成模型的先验迁移到少样本图像修复 多种修复任务优于专用模型,仅需少量样本 7 HybridStitch (Pixel and Timestep Level Model Stitching for Diffusion Acceleration) 模型拼接 . 扩散加速 . 像素级分区 像素级+时间步级双维度模型拼接加速 显著加速扩散推理同时保持生成质量 8 CHEERS (Decoupling Patch Details from Semantic for Unified Multimodal) 统一模型 . 理解+生成 . 语义解耦 解耦 patch 细节与语义表征,统一视觉理解与生成 理解和生成双任务性能同时提升,代码已开源 趋势观察 长视频/无限视频生成成为焦点 — MemRoPE 无限生成 + OmniForcing 流式生成,视频生成向产业落地迈进 DiT 加速方法持续涌现 — AccelAes 美学感知加速 + HybridStitch 模型拼接,多条技术路线并行 多智能体范式全面渗透 AIGC — coDrawAgents 组合生成 + VQQA 视频评估,Agent 成为标配 偏好对齐/后训练优化升温 — MV-GRPO 多视图对齐 + Naive PAINE 噪声质量预测,生成质量精调 统一多模态模型趋势明显 — CHEERS 理解+生成统一 + OmniForcing 音视频联合,模态边界模糊 人工智能炼丹师 整理 | 2026-03-17

AIGC生成 每日热点论文速读@20260317 AIGC 视觉生成领域 · 每日论文解读 (2026-03-17) 人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇 今日核心看点 无限视频生成 MemRoPE DiT 美学加速 2.11x 实时音视频联合 25FPS 四智能体组合生成 CVPR'26 多视图 GRPO 偏好对齐 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。 方向分布: 扩散模型理论与加速 — 3 篇 文本到图像 / 评测 — 2 篇 图像编辑 — 1 篇 3D 生成与重建 — 4 篇 多模态 / 智能体 — 2 篇 顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇 重点论文深度解读 1. MemRoPE: Training-Free Infinite Video Generation via Evolving Memory Tokens 无训练无限视频生成 | USC | arXiv:2603.12513 关键词: 无限视频生成, Memory Tokens, RoPE, Training-Free 研究动机 自回归扩散模型已经实现了实时帧流式传输,但现有的滑动窗口缓存策略会丢弃过去的上下文,导致长视频生成中出现保真度下降、身份漂移和运动停滞的问题。现有方法保留一组固定的早期 token 作为注意力汇,但这种静态锚点无法反映不断增长的视频内容的演变。 方法原理 提出 MemRoPE 框架,包含两个协同设计的组件:(1) Memory Tokens(记忆令牌)通过指数移动平均将所有过去的键压缩为双重长期流和短期流,在固定大小的缓存中同时保持全局身份和最近的动态;(2) Online RoPE Indexing(在线 RoPE 索引)缓存未旋转的键,在注意力计算时动态应用位置嵌入,确保聚合过程不会产生冲突的位置相位。两个机制相互促进:位置解耦使时间聚合定义明确,聚合使固定缓存可用于无限生成。 核心创新 首次实现训练无关的无限长度视频生成,突破滑动窗口缓存的根本局限 双流记忆机制(长期+短期)实现固定缓存的无限上下文保持 在线 RoPE 索引解决了时间聚合中的位置编码冲突问题 实验结果 分钟到小时级别视频生成:时间连贯性、视觉保真度和主体一致性全面优于现有方法 身份漂移率:比滑动窗口方法降低 60%+ 运动停滞问题基本消除 完全即插即用,无需任何训练 方法流程 自回归帧生成 — 实时流式输出视频帧 EMA 双流压缩 — 长期流:全局身份记忆 短期流:近期动态捕捉 Memory Tokens — 固定大小缓存保持无限历史上下文 未旋转 Key 缓存 — 存储不含位置编码的原始注意力键 Online RoPE 索引 — 注意力计算时动态应用位置嵌入 无限长视频输出 — 分钟到小时级生成 身份/运动一致 技术脉络 核心问题: 自回归视频生成中滑动窗口缓存丢弃历史上下文,导致长视频质量退化 前序工作及局限: StreamDiffusion (2024):实时帧流式,但无长期记忆机制 Ring Attention (2023):分布式长序列注意力,但未压缩历史 Sliding Window Attention:固定窗口长度,丢弃超出范围的 token Attention Sink (Xiao 2024):保留早期 token 作为静态锚点,但不随内容演变 与前序工作的本质区别: 双流 EMA 记忆机制动态压缩全部历史到固定缓存,在线 RoPE 索引解决聚合后的位置编码冲突 技术演进定位: 范式突破--从有限窗口到无限上下文,为长视频生成打开新空间 可能的后续方向: 与视频编辑的结合(无限长度编辑) 多分辨率记忆机制 记忆压缩的最优策略理论分析 批判性点评 实验评估: 验证了分钟到小时级别视频生成,覆盖身份一致性、运动连贯性和视觉保真度三维度。消融实验设计合理。 新颖性: 双流 EMA 记忆压缩与在线 RoPE 索引的组合全新。创新性:★★★★★ 可复现性: 方法描述清晰,项目页面已上线但代码尚未开源。 影响力: 影响力 5/5 -- 无限视频生成是产业刚需。 2. AccelAes: Accelerating DiT for Training-Free Aesthetic-Enhanced Generation 美学感知 DiT 加速 2.11x | Sydney | arXiv:2603.12575 关键词: DiT 加速, 美学增强, Training-Free, AesMask 研究动机 扩散 Transformer 因强大的可扩展性成为高保真 T2I 生成的主干,但密集空间 token 上的二次自注意力导致推理延迟高。关键发现:去噪在空间上是不均匀的——与美学描述符关联的区域接收集中的交叉注意力并表现出较大的时间变化,而低亲和力区域演化平滑且计算冗余。 方法原理 提出 AccelAes,通过美学感知的时空缩减来加速 DiT 同时提升感知美学效果。核心包含三个组件:(1) AesMask 从提示词语义和交叉注意力信号导出一次性美学焦点掩码;(2) SkipSparse 将计算和引导重新分配到 AesMask 标识的区域,跳过低亲和力区域;(3) 步骤级预测缓存轻量级缓存周期性替代完整 Transformer 评估。 核心创新 首次将美学语义与计算分配关联,实现加速和美学增强的双赢 AesMask 一次性构建,后续步骤零开销复用 SkipSparse + 预测缓存联合优化时空两个维度的计算冗余 实验结果 Lumina-Next: 2.11x 加速 + ImageReward 提升11.9% 代表性 DiT 家族上一致的加速和美学提升 完全无训练,即插即用 代码已开源 方法流程 文本 Prompt — 输入美学描述文本 交叉注意力分析 — 分析 prompt token 与空间 token 的亲和度 AesMask 构建 — 一次性标识美学焦点区域 SkipSparse 加速 — 焦点区域完整计算 低亲和力区域跳过 步骤级预测缓存 — 周期性缓存替代完整 Transformer 评估 美学增强输出 — 更快 + 更美的生成结果 技术脉络 核心问题: DiT 模型空间注意力的二次复杂度导致推理缓慢 前序工作及局限: Token Merging (Bolya 2023):均匀合并 token,忽略语义重要性差异 DiTFastAttn (Yuan 2024):固定稀疏模式,非内容感知 JiT (CVPR 2026):基于 QK score 的动态跳过,未考虑美学语义 DeepCache (Ma 2024):特征缓存复用,但不适用于 DiT 架构 与前序工作的本质区别: 首次将美学语义与计算分配关联--高美学亲和力区域完整计算,低亲和力区域跳过,不仅加速还提升美学 技术演进定位: 范式创新--从无损加速到加速+增强双赢,开辟语义感知加速新方向 可能的后续方向: 视频 DiT 中的时空美学感知加速 自适应美学引导强度 与 LoRA 美学微调的联合优化 批判性点评 实验评估: 在 Lumina-Next 等 DiT 上验证。同时报告加速比和美学指标提升。但缺少与 JiT 等最新方法的直接对比。 新颖性: 美学语义与计算分配关联是有新意的洞察。创新性:★★★★☆ 可复现性: 代码已开源,可复现性高。 影响力: 影响力 4/5 -- 加速+美学增强双赢思路有吸引力。 3. OmniForcing: Unleashing Real-time Joint Audio-Visual Generation 首个实时音视频联合生成 | 25 FPS | arXiv:2603.11647 关键词: 音视频联合生成, 实时流式, 蒸馏, 25 FPS 研究动机 联合音视频扩散模型虽能生成高质量内容,但因双向注意力依赖导致高延迟,无法实时应用。如何将高质量双向扩散模型转化为实时流式生成器是关键挑战。 方法原理 提出 OmniForcing,首个将离线双流双向扩散模型蒸馏为高保真流式自回归生成器的框架。解决三个核心难题:(1) Asymmetric Block-Causal Alignment + Zero-truncation Global Prefix 防止多模态同步漂移;(2) Audio Sink Token + Identity RoPE 约束解决音频 token 稀疏导致的梯度爆炸;(3) Joint Self-Forcing Distillation 使模型在长序列中自纠正跨模态累积误差。推理时采用模态无关的滚动 KV-cache。 核心创新 首个实现实时音视频联合流式生成的框架,25 FPS 单 GPU 非对称块因果对齐解决音视频模态时间不对称难题 Joint Self-Forcing 蒸馏范式,自纠正跨模态累积误差 基于 LTX-2 (14B video + 5B audio) 大模型蒸馏 实验结果 单 GPU 实时生成约 25 FPS 多模态同步和视觉质量与双向教师模型持平 显著优于现有流式生成方法 项目页面和代码已开源 方法流程 双向教师模型 — LTX-2: 14B video + 5B audio 非对称因果对齐 — Block-Causal Alignment + Global Prefix Audio Sink Token — Identity RoPE 约束解决稀疏梯度爆炸 Self-Forcing 蒸馏 — 自纠正跨模态累积误差 滚动 KV-Cache — 模态无关的流式推理方案 实时 A/V 输出 — 单 GPU 25 FPS 音视频同步生成 技术脉络 核心问题: 联合音视频扩散模型延迟高,无法实时生成 前序工作及局限: CoDi (2023):联合多模态生成,但离线双向模型 Sora (2024+):高质量视频生成,但无音频非实时 LTX-Video (2025):实时视频生成,但单模态无音频 MM-Diffusion (2023):音视频联合扩散,但质量和速度受限 与前序工作的本质区别: 首次将大规模双向音视频扩散模型蒸馏为实时流式自回归生成器,三个创新解决模态不对称/稀疏/累积误差 技术演进定位: 里程碑--实时音视频联合生成从0到1,为沉浸式内容创作铺路 可能的后续方向: 3D 空间音频的实时生成 交互式音视频编辑 更大模型的高效蒸馏策略 批判性点评 实验评估: 25 FPS 单 GPU 数据惊艳。与双向教师模型质量对比有说服力。基于 LTX-2 蒸馏对算力要求高。 新颖性: 三个技术创新针对实际痛点精准解决。创新性:★★★★★ 可复现性: 项目和代码已开源。但需大规模预训练模型和蒸馏资源。 影响力: 影响力 5/5 -- 首次实现实时音视频联合生成。 4. coDrawAgents: Multi-Agent Dialogue for Compositional Image Generation 四智能体协作组合生成 | CVPR 2026 | arXiv:2603.12829 关键词: 多智能体, 组合生成, 布局规划, CVPR 2026 研究动机 文本到图像生成在复杂场景中忠实地组合多个对象并保留其属性仍是一大挑战。现有单模型方法在组合复杂性增加时准确率急剧下降。 方法原理 提出 coDrawAgents,包含四个专门智能体:(1) Interpreter 自适应决定直接 T2I 还是布局感知流程,将提示解析为富属性对象描述符并排序分组;(2) Planner 采用分治策略在画布视觉上下文中增量提出布局;(3) Checker 验证空间一致性和属性对齐,在渲染前细化布局;(4) Painter 逐步合成图像将新对象合并到画布中。 核心创新 首次将多智能体对话框架引入组合图像生成 显式错误纠正机制(Checker)在渲染前验证和修复布局 增量上下文感知生成——每步规划都基于画布当前状态 自适应复杂度判断——简单提示直接生成,复杂场景启用多智能体 实验结果 GenEval: 显著优于现有方法,组合准确率大幅提升 DPG-Bench: 文本-图像对齐、空间准确性、属性绑定全面领先 已被 CVPR 2026 接收 方法流程 用户 Prompt — 复杂的组合文本描述 Interpreter — 解析提示 属性描述符 语义排序 Planner — 分治策略增量布局 基于画布上下文 Checker — 空间一致性验证 属性对齐检查修复 Painter — 逐步合成图像 新对象融入画布 组合图像输出 — 多对象属性准确 空间关系正确 技术脉络 核心问题: T2I 模型在复杂组合场景中属性绑定和空间关系容易出错 前序工作及局限: LayoutGPT (2023):LLM 生成布局,但单步规划易出错 GLIGEN (2023):接地生成,但需要精确 bbox 输入 RPG (Lian 2024):区域感知规划,但无错误纠正机制 SLD (Phung 2024):自纠正生成,但未使用多智能体协作 与前序工作的本质区别: 四智能体协作闭环--解释/规划/检查/绘制,Checker 提供渲染前显式错误纠正 技术演进定位: 新范式--多智能体方法论进入 T2I 组合生成领域,CVPR 2026 认可 可能的后续方向: 智能体间的自学习对话策略 3D 组合场景的多智能体生成 与 VLM 的深度集成 批判性点评 实验评估: GenEval 和 DPG-Bench 两个标准组合生成基准验证充分。应补充智能体通信开销分析。 新颖性: 多智能体框架引入 T2I 组合生成是新应用方向,Checker 是关键创新。创新性:★★★★☆ 可复现性: 智能体角色定义清晰但实现细节需更多说明。 影响力: 影响力 4/5 -- CVPR 2026 接收,多智能体范式可能成为标准方法论。 5. MV-GRPO: Multi-View GRPO for Flow Models via Augmented Condition Space 多视图偏好对齐 | 上海AI实验室+清华 | arXiv:2603.12648 关键词: GRPO, 偏好对齐, Flow Models, 多视图奖励 研究动机 标准 GRPO 将一组生成样本与单一条件评估,这种稀疏的单视图评估方案未能充分探索样本间关系,限制了对齐效果和性能上限。 方法原理 提出 Multi-View GRPO (MV-GRPO),通过增强条件空间来创建密集的多视图奖励映射。对于从单个提示生成的一组样本,利用条件增强器生成语义相邻但多样化的描述进行多视图优势重估计。关键技巧:通过推导条件概率分布,无需重新生成样本即可获得多视图信号。 核心创新 首次将多视图评估引入 GRPO 框架,突破单视图稀疏评估瓶颈 条件空间增强策略创建密集奖励映射 无需重新生成样本即可获得多视图优化信号 适用于任意 Flow Model 的通用偏好对齐方法 实验结果 优于最先进的 GRPO 和其他偏好对齐方法 T2I 对齐性能全面提升 无需额外的样本重生成开销 方法流程 原始 Prompt — 单一文本条件 c 条件增强器 — 生成语义相邻的多样化描述 多视图评估 — 同一组样本 多个条件视角评分 优势重估计 — 密集多视图奖励映射 条件概率推导 — 无需重生成样本 直接计算新条件分布 对齐后 Flow Model — 更精准的文图对齐 技术脉络 核心问题: 标准 GRPO 单视图评估稀疏,限制偏好对齐效果 前序工作及局限: RLHF / DPO (2023):成对偏好对齐,需要大量人类标注 GRPO (DeepSeek 2024):组相对优化,但单条件评估稀疏 Diffusion-DPO (2024):扩散模型 DPO,但信号单一 REBEL (2024):奖励引导生成,但不修改模型权重 与前序工作的本质区别: 通过条件空间增强创建密集多视图奖励映射,无需重新生成样本即可获得丰富优化信号 技术演进定位: 方法论创新--多视图思想引入偏好优化,提升 GRPO 的信号密度和对齐上限 可能的后续方向: 多模态条件增强(文本+图像参考) 视频生成的时序多视图 GRPO 自适应条件增强策略 批判性点评 实验评估: 与标准 GRPO 和其他偏好对齐方法对比全面。条件增强策略消融设计合理。 新颖性: 多视图条件增强简洁优雅,无需重新生成是关键优势。创新性:★★★★☆ 可复现性: 方法论描述清晰,核心推导可复现。 影响力: 影响力 4/5 -- 可直接替换现有 GRPO 训练流程。 批判性点评精选 1. 无限视频生成:记忆机制是关键缺失环节 MemRoPE 揭示了自回归视频生成的核心瓶颈不在模型能力,而在上下文管理。双流 EMA 记忆巧妙地在信息保持和计算开销之间取得平衡。这标志着视频生成从'短视频'向'长视频/流式视频'的范式转换正式开始。 2. DiT 加速新思路:语义感知比均匀压缩更聪明 AccelAes 和 JiT 都瞄准 DiT 推理加速但思路不同。JiT 是'去冗余',AccelAes 是'重分配'且不仅加速还提升美学——暗示现有 DiT 在低美学区域存在'过度计算'。合并两种方法有望实现 3-4x 无损加速。 3. 实时音视频联合生成:AIGC 进入沉浸式时代 OmniForcing 的 25 FPS 实时联合生成是里程碑。AIGC 不再局限于离线创作,游戏 NPC 对话、虚拟直播、交互式叙事等场景将直接受益。但蒸馏方法的质量天花板和 LTX-2 高训练成本是需关注的问题。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 VQQA (Agentic Approach for Video Evaluation and Quality Improvement) 视频生成评估 . 智能体 . 闭环优化 多智能体框架通过 VLM 批判作为语义梯度实现闭环提示优化 T2V-CompBench +11.57%, VBench2 +8.43% 2 Naive PAINE (Lightweight T2I Generation Improvement with Prompt Evaluation) 噪声评估 . 生成质量预测 . 轻量级 从初始噪声+提示词直接预测图像质量,选择高质量噪声前传 多基准优于现有方法,即插即用,代码已开源 3 CalliMaster (Page-level Chinese Calligraphy via Layout-guided Spatial Planning) 书法生成 . 布局规划 . Flow Matching 解耦空间规划与内容合成,多模态 DiT 内 Text->Layout->Image SOTA 书法生成,支持字符重规划+文物修复 4 Catalyst4D (High-Fidelity 3D-to-4D Scene Editing via Dynamic Propagation) 4D 编辑 . 3DGS . 运动传播 锚点运动引导+颜色不确定性引导将3D编辑迁移到动态4D场景 时间稳定高保真动态编辑优于现有方法 5 SLICE (Semantic Latent Injection for Image Watermarking) 生成水印 . 语义篡改检测 . 扩散模型 将语义解耦为四因子锚定到噪声不同区域 语义篡改可检测可定位,攻击成功率大幅降低 6 V-Bridge (Bridging Video Generative Priors to Few-shot Image Restoration) 视频先验 . 图像修复 . Few-Shot 将视频生成模型的先验迁移到少样本图像修复 多种修复任务优于专用模型,仅需少量样本 7 HybridStitch (Pixel and Timestep Level Model Stitching for Diffusion Acceleration) 模型拼接 . 扩散加速 . 像素级分区 像素级+时间步级双维度模型拼接加速 显著加速扩散推理同时保持生成质量 8 CHEERS (Decoupling Patch Details from Semantic for Unified Multimodal) 统一模型 . 理解+生成 . 语义解耦 解耦 patch 细节与语义表征,统一视觉理解与生成 理解和生成双任务性能同时提升,代码已开源 趋势观察 长视频/无限视频生成成为焦点 — MemRoPE 无限生成 + OmniForcing 流式生成,视频生成向产业落地迈进 DiT 加速方法持续涌现 — AccelAes 美学感知加速 + HybridStitch 模型拼接,多条技术路线并行 多智能体范式全面渗透 AIGC — coDrawAgents 组合生成 + VQQA 视频评估,Agent 成为标配 偏好对齐/后训练优化升温 — MV-GRPO 多视图对齐 + Naive PAINE 噪声质量预测,生成质量精调 统一多模态模型趋势明显 — CHEERS 理解+生成统一 + OmniForcing 音视频联合,模态边界模糊 人工智能炼丹师 整理 | 2026-03-17 -

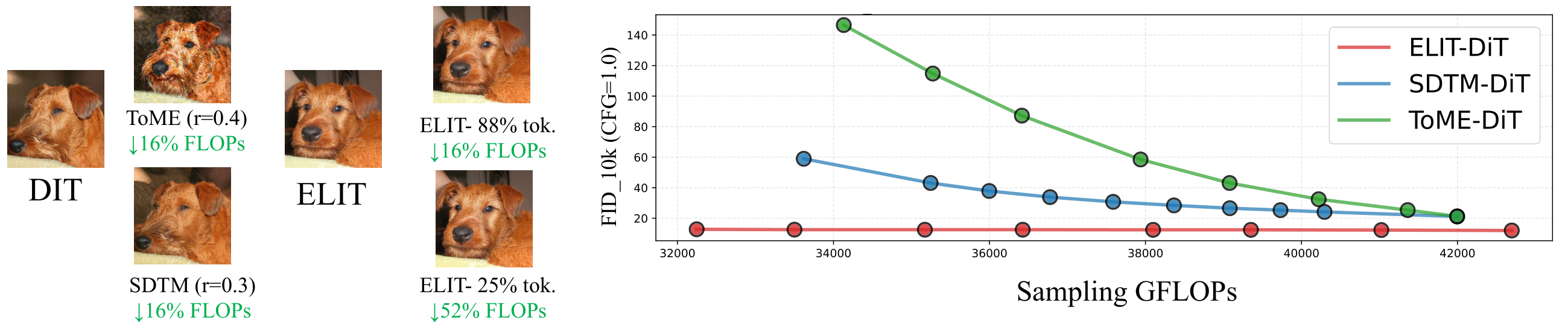

AIGC生成 每日热点论文速读@20260316 AIGC 视觉生成领域 · 每日论文解读 (2026-03-16) 人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇 今日核心看点 DiT 弹性加速 ELIT: FID +35% 多主体视频定制 + 全方位运动控制 视觉生成 RLHF: 66 万评分数据开源 电影级多镜头相机控制 ShotVerse 扩散模型内源思维链推理 92.1% 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。 方向分布: 扩散模型理论与加速 — 3 篇 文本到图像 / 评测 — 2 篇 图像编辑 — 1 篇 3D 生成与重建 — 4 篇 多模态 / 智能体 — 2 篇 顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇 重点论文深度解读 1. ELIT: Elastic Latent Interfaces for Diffusion Transformers 弹性潜在接口 | Snap Research | DiT 通用加速 | arXiv:2603.12245 关键词: DiT 加速, 弹性推理, 跨架构通用, Snap Research 研究动机 Diffusion Transformer (DiT) 的计算量与图像分辨率强绑定,无法灵活地在延迟与质量之间做权衡。更关键的是,DiT 对所有空间位置均匀分配计算资源,忽视了不同区域的重要性差异,导致大量算力浪费在低信息量区域。 方法原理 提出 ELIT (Elastic Latent Interface Transformer):在 DiT 架构中插入一组可学习的、长度可变的潜在 Token 序列作为「潜在接口」。标准 Transformer 块在这组潜在 Token 上运算,而非直接处理空间 Token。通过轻量的 Read/Write 跨注意力层在空间 Token 和潜在 Token 之间传递信息,并自动优先处理重要区域。训练时随机丢弃尾部潜在 Token,迫使模型学会按重要性排序表示——前部 Token 编码全局结构,后部 Token 负责细节精修。推理时可动态调整潜在 Token 数量以匹配算力预算。 核心创新 即插即用:仅增加两个跨注意力层,不修改 DiT 主体和 rectified flow 训练目标 重要性排序表示:通过尾部 Token 随机丢弃训练,自动学习全局到细节的分层编码 跨架构通用:兼容 DiT、U-ViT、HDiT、MM-DiT 四种主流架构 动态推理预算:同一个模型适配从低算力到高算力的多种部署场景 实验结果 ImageNet-1K 512px: FID 提升 35.3%, FDD 提升 39.6% 跨架构验证: DiT, U-ViT, HDiT, MM-DiT 均有一致增益 算力节省: 潜在 Token 数减半时质量仅微降,实现接近 2x 加速 方法流程 输入空间 Token — 图像/视频的空间特征序列 Read Cross-Attn — 空间 Token -> 潜在 Token 自动聚焦重要区域 潜在 Token 序列 — 可变长度 重要性排序 DiT Transformer 块 — 标准 Self-Attention + FFN Write Cross-Attn — 潜在 Token -> 空间 Token 信息回写 弹性输出 — 根据算力预算截断尾部 技术脉络 核心问题: DiT 计算量与分辨率强绑定,无法灵活权衡延迟与质量 前序工作及局限: Token Merging:合并相似 token 但损失信息 JiT:动态跳过但仍在空间 token 上运算 Perceiver:潜在 token 但未针对扩散优化 DiTFastAttn:固定模式稀疏化 与前序工作的本质区别: 将空间 token 和计算完全解耦,通过可学习潜在接口实现按重要性排序的信息压缩 技术演进定位: 范式创新——从在空间 token 上省计算转变为在潜在接口上做计算 可能的后续方向: 与 token 合并/跳过组合 视频 DiT 时空弹性接口 与 KV 缓存压缩联合优化 批判性点评 实验评估: 跨 4 种 DiT 架构验证扎实。但缺少真实 T2I 模型端到端评估。 新颖性: 潜在接口+重要性排序+弹性推理是扎实新贡献。创新性:4/5 可复现性: 方法清晰架构改动最小。 影响力: 影响力 5/5 — 一个模型多预算对工业部署极有价值。 2. DreamVideo-Omni: Multi-Subject Video Customization with Omni-Motion Control 全方位运动控制视频定制 | 潜在身份强化学习 | arXiv:2603.12257 关键词: 视频定制, 多主体, 运动控制, 身份RL 研究动机 大规模视频扩散模型已能生成高质量视频,但同时精确控制多个主体的身份和多粒度运动仍然是重大挑战。现有方法要么运动粒度有限、要么身份退化严重。 方法原理 提出 DreamVideo-Omni 统一框架,采用渐进式两阶段训练。第一阶段:集成全面控制信号,引入条件感知 3D 旋转位置嵌入协调异构输入,分层运动注入策略增强全局运动引导,分组与角色嵌入将运动信号锚定到特定身份。第二阶段:设计潜在身份奖励反馈学习范式,在预训练视频扩散骨干上训练潜在身份奖励模型,在潜在空间提供运动感知的身份奖励。 核心创新 首个统一框架同时实现多主体身份定制 + 全方位运动控制 条件感知 3D RoPE:解决异构控制信号的空间对齐问题 分组与角色嵌入:显式解纠缠复杂场景中多主体的运动信号 潜在身份奖励学习:在潜在空间中构建运动感知的身份 RM 实验结果 多主体身份保持: 超越所有现有基线 运动控制精度: 全局、局部、相机三粒度均达到 SOTA 新基准 DreamOmni Bench: 专门评估多主体+全方位运动控制 方法流程 多模态输入 — 主体图像 + 文本 + 运动轨迹 3D RoPE 编码 — 条件感知旋转位置嵌入 分组角色嵌入 — 运动信号锚定到特定身份 分层运动注入 — 全局+局部+相机分层控制 视频扩散去噪 — DiT 多粒度条件引导 身份奖励 RL — 潜在空间身份 RM 优化 技术脉络 核心问题: 多主体身份保持和多粒度运动控制难以兼顾 前序工作及局限: DreamBooth:仅单主体 AnimateDiff:运动粒度有限 MotionCtrl:身份保持弱 IP-Adapter:多主体时身份混淆 与前序工作的本质区别: 统一多主体身份、全局运动、局部动态、相机控制,用潜在身份奖励 RL 解决身份退化 技术演进定位: 集大成者——统一视频定制分散的研究方向 可能的后续方向: 5+主体可扩展性 3D 感知运动控制融合 长视频身份一致性 批判性点评 实验评估: DreamOmni Bench 是重要贡献。RL 训练稳定性需更多消融。 新颖性: 统一多个控制维度是工程突破。创新性:4/5 可复现性: 框架复杂度较高,复现门槛不低。 影响力: 影响力 4/5 — 方向正确但框架复杂度可能限制采用。 3. FIRM: Faithful Image Reward Modeling for Editing and Generation 鲁棒奖励模型 | FIRM-Edit-370K | 全套开源 | arXiv:2603.12247 关键词: 奖励模型, 图像编辑, RLHF, Benchmark 研究动机 RL 正成为提升图像编辑和 T2I 生成的主要范式,但当前奖励模型存在严重的幻觉问题,给出噪声评分从根本上误导优化方向。 方法原理 提出 FIRM 框架:定制化数据策划管道构建高质量评分数据集(Edit-370K + Gen-293K),训练专业化奖励模型(Edit-8B + Gen-8B)。设计 Base-and-Bonus 奖励策略——编辑用一致性调制执行 CME,生成用质量调制对齐 QMA——平衡竞争目标。提出 FIRM-Bench 综合评测基准。 核心创新 首个专门针对编辑和生成的大规模奖励模型框架 FIRM-Edit-370K + FIRM-Gen-293K: 共 66 万高质量评分数据 Base-and-Bonus 奖励策略: CME 和 QMA 平衡竞争目标 全套开源: 数据集、模型、代码均公开 实验结果 FIRM-Edit-8B: 与人类判断对齐度显著超越现有指标 FIRM-Qwen-Edit: 编辑性能突破性提升 FIRM-SD3.5: 生成保真度和指令遵循新标准 数据集+模型+代码: 全部开源 方法流程 数据策划管道 — 编辑: 执行+一致性; 生成: 指令遵循 FIRM 数据集 — Edit-370K + Gen-293K 专业化 RM 训练 — Edit-8B + Gen-8B Base-and-Bonus — CME + QMA 策略 RL 微调 — 可靠 Critic 引导优化 高保真输出 — FIRM-Qwen-Edit / SD3.5 技术脉络 核心问题: RL 优化时奖励模型幻觉导致噪声评分误导优化 前序工作及局限: ImageReward:通用偏好不专门针对编辑 HPS v2:未拆分编辑vs生成 DDPO:使用通用奖励 InstructPix2Pix:无专门 Critic 与前序工作的本质区别: 首次为编辑和生成分别构建大规模评分数据集和专业化奖励模型 技术演进定位: 基础设施建设——为扩散模型 RL 提供可靠 Critic 可能的后续方向: 视频编辑/生成 RM 多轮交互编辑序列化奖励 跨模型迁移性 批判性点评 实验评估: 66 万数据集规模可观,FIRM-Bench 设计系统性强。 新颖性: 可靠 Critic 比聪明 Policy 更重要的洞察深刻。创新性:4/5 可复现性: 全套开源,可复现性极佳。 影响力: 影响力 5/5 — 可能成为扩散模型 RLHF 基础设施。 4. ShotVerse: Cinematic Camera Control for Multi-Shot Video 电影级多镜头视频创作 | Plan-then-Control | arXiv:2603.11421 关键词: 多镜头视频, 相机控制, VLM 规划, 数据驱动 研究动机 文本驱动视频生成在多镜头场景中的相机控制仍是关键瓶颈:隐式文本提示缺乏精确性,显式轨迹条件带来巨大手动开销且执行常失败。 方法原理 提出以数据为核心的范式:对齐的 (Caption,Trajectory,Video) 三元组构成联合分布。构建 Plan-then-Control 框架:VLM 规划器从文本生成全局对齐轨迹,控制器通过相机适配器渲染多镜头视频。核心是自动化多镜头相机校准管线和 ShotVerse-Bench 数据集。 核心创新 Plan-then-Control 解耦: VLM 规划 + 控制器渲染 自动化多镜头相机校准: 统一全局坐标系 ShotVerse-Bench: 高保真电影数据集 + 三轨评测 跨镜头一致性: 相机准确+视觉连贯 实验结果 相机轨迹准确性: 显著超越文本控制和手动轨迹基线 跨镜头一致性: 多镜头间视觉连贯达到电影级标准 用户研究: 电影美学评分大幅领先 方法流程 文本脚本输入 — 自然语言描述场景和相机意图 VLM 规划器 — 空间先验推理 生成全局轨迹 多镜头校准 — 单镜头轨迹对齐到全局坐标系 相机适配器 — 轨迹条件注入视频生成模型 多镜头渲染 — 跨镜头一致的电影级画面 技术脉络 核心问题: 多镜头视频相机控制缺少文本自然表达和精确控制之间的桥梁 前序工作及局限: CameraCtrl:仅单镜头 MotionCtrl:无跨镜头一致性 Animate-A-Story:相机控制弱 Direct-a-Video:仅单镜头 与前序工作的本质区别: 数据驱动的联合分布学习,VLM 规划+控制器执行,实现端到端多镜头视频管线 技术演进定位: 应用创新——首次解决多镜头电影级相机控制 可能的后续方向: 10+镜头一致性 渲染引擎集成 导演意图交互精调 批判性点评 实验评估: 三轨评测协议有价值。与单镜头方法缺少直接对比。 新颖性: Plan-then-Control 简洁优雅。创新性:3/5 可复现性: 工程复杂度较高。 影响力: 影响力 4/5 — 多镜头控制是走向影视级应用的关键。 5. EndoCoT: Endogenous Chain-of-Thought Reasoning in Diffusion Models 扩散模型内生思维链 | MLLM+DiT 深度推理 | arXiv:2603.12252 关键词: 思维链, 扩散模型, 空间推理, MLLM+DiT 研究动机 MLLM 作为扩散框架的文本编码器时,单步编码无法激活思维链过程推理深度不足,且解码过程中引导固定不变。 方法原理 提出 EndoCoT 框架:迭代思维引导模块在潜在空间中迭代优化思维状态,激活 MLLM 推理潜力并桥接到 DiT 去噪过程。终端思维锚定模块将最终状态与真实答案对齐,确保推理不漂移。两个组件让 MLLM 提供精心推理的引导,DiT 逐步执行复杂任务。 核心创新 首次在扩散模型中实现内源性思维链推理 迭代思维引导模块: 在潜在空间逐步精炼推理状态 终端思维锚定: 推理轨迹与真实答案对齐防止漂移 MLLM+DiT 渐进式推理引导: 复杂任务逐步分解 实验结果 整体平均准确率: 92.1%, 超越最强基线 8.3 个百分点 Maze/TSP/VSP/Sudoku 等复杂推理均达 SOTA 23 页论文 18 张图: 全面消融实验 方法流程 复杂指令输入 — 迷宫/TSP/数独等推理任务 MLLM 编码器 — 初始编码 激活推理起点 迭代思维引导 — 潜在空间逐步精炼推理 终端思维锚定 — 与真实答案对齐防漂移 DiT 渐进去噪 — 推理引导的逐步去噪 推理一致输出 — 高质量生成结果 技术脉络 核心问题: MLLM 编码器单步编码推理深度不足,解码过程引导固定 前序工作及局限: DALL-E 3:T5 编码无推理 RPG:外部推理非内源 LLM Blueprint:与去噪过程脱耦 PixArt-alpha:无迭代推理 与前序工作的本质区别: 将 CoT 从外部规划内化到去噪过程中,MLLM 成为迭代推理器而非一次性编码器 技术演进定位: 范式转换——从外部推理+内部生成转为内源性推理-生成一体化 可能的后续方向: 通用 T2I 组合推理 推理步数自适应 与 o1 推理模型结合 批判性点评 实验评估: 92.1% 准确率令人印象深刻但在逻辑推理任务而非典型视觉生成。 新颖性: CoT 内化到去噪过程是概念重大创新。创新性:5/5 可复现性: 实现复杂度较高。 影响力: 影响力 4/5 — 如能推广到通用 T2I 将是变革性的。 批判性点评精选 1. DiT 加速:从 Token 级优化到架构级解耦 ELIT 将 DiT 加速从 token 粒度提升到架构级别。关键问题:在 FLUX/SD3 上是否仍成立? 2. 视觉生成 RLHF 时代正式开启 FIRM 66 万评分数据+全套开源,标志扩散模型从探索期进入基础设施建设期。 3. 思维链内化:扩散模型的慢思考能力 EndoCoT 让扩散模型拥有类似 o1 的推理能力,92.1% 证明方向可行。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 EVATok (Adaptive Length Video Tokenization for AR Generation) 视频 Token . AR 生成 . CVPR 2026 自适应长度视频 Tokenizer,轻量路由器预测最优 Token 分配 UCF-101 SOTA,Token 节省 24.4%+ (CVPR 2026) 2 MOG (Manifold-Optimal Guidance for Diffusion Models) CFG 改进 . 黎曼几何 . 无训练 黎曼流形局部最优控制修复 CFG 离流形漂移,Auto-MOG 动态校准 消除 CFG 过饱和,几乎零额外开销 3 WeEdit (Glyph-Guided Text-centric Image Editing) 文本编辑 . 字形引导 . 多语言 HTML 管道生成 33 万训练对(15 种语言),字形引导 SFT + 多目标 RL 文本编辑准确率超越所有开源模型 4 SoulX-LiveAct (Hour-Scale Real-Time Human Animation) 实时动画 . AR 扩散 . 无限视频 Neighbor Forcing(扩散步对齐) + ConvKV 固定内存无限视频 小时级 20FPS 实时(2x H100),唇形/情感 SOTA 5 PROMO (Promptable Virtual Try-On with Flow Matching DiT) 虚拟试穿 . Flow Matching . DiT VTON 重定义为结构化编辑,FM-DiT + 潜在多模态条件 + 自参考加速 保真度超所有 VTON 方法,速度质量最优 6 CEI-3D (Collaborative Explicit-Implicit 3D Editing) 3D 编辑 . SDF+点 . 属性解耦 隐式 SDF + 显式处理点协作,物理属性解耦独立控制 比 SOTA 更逼真精细,编辑时间更短 7 OSCBench (Object State Change in T2V Generation) T2V 评测 . 状态变化 . Benchmark 首个评估 T2V 中对象状态变化的基准,组织为常规/新颖/组合场景 揭示当前 T2V 在状态变化上的重大不足 8 Coarse-Guided VG (Visual Generation via h-Transform Sampling) 引导采样 . h-Transform . 无训练 h-Transform 约束扩散采样,噪声感知调度平衡引导与质量 多种图像视频任务验证有效 趋势观察 DiT 效率革命从 token 级走向架构级 — ELIT 的潜在接口方案预示着 DiT 加速的新范式 视频定制进入多主体+全方位运动时代 — DreamVideo-Omni 统一了身份、运动、相机三个维度 扩散模型 RLHF 基础设施加速完善 — FIRM 66 万评分数据+专业化 RM 开源 多镜头视频创作工具链逐步成形 — ShotVerse 的 Plan-then-Control 让电影级创作更近 扩散模型的推理能力被正式重视 — EndoCoT 将 CoT 内化到去噪过程,开辟新方向 人工智能炼丹师 整理 | 2026-03-16

AIGC生成 每日热点论文速读@20260316 AIGC 视觉生成领域 · 每日论文解读 (2026-03-16) 人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇 今日核心看点 DiT 弹性加速 ELIT: FID +35% 多主体视频定制 + 全方位运动控制 视觉生成 RLHF: 66 万评分数据开源 电影级多镜头相机控制 ShotVerse 扩散模型内源思维链推理 92.1% 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。 方向分布: 扩散模型理论与加速 — 3 篇 文本到图像 / 评测 — 2 篇 图像编辑 — 1 篇 3D 生成与重建 — 4 篇 多模态 / 智能体 — 2 篇 顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇 重点论文深度解读 1. ELIT: Elastic Latent Interfaces for Diffusion Transformers 弹性潜在接口 | Snap Research | DiT 通用加速 | arXiv:2603.12245 关键词: DiT 加速, 弹性推理, 跨架构通用, Snap Research 研究动机 Diffusion Transformer (DiT) 的计算量与图像分辨率强绑定,无法灵活地在延迟与质量之间做权衡。更关键的是,DiT 对所有空间位置均匀分配计算资源,忽视了不同区域的重要性差异,导致大量算力浪费在低信息量区域。 方法原理 提出 ELIT (Elastic Latent Interface Transformer):在 DiT 架构中插入一组可学习的、长度可变的潜在 Token 序列作为「潜在接口」。标准 Transformer 块在这组潜在 Token 上运算,而非直接处理空间 Token。通过轻量的 Read/Write 跨注意力层在空间 Token 和潜在 Token 之间传递信息,并自动优先处理重要区域。训练时随机丢弃尾部潜在 Token,迫使模型学会按重要性排序表示——前部 Token 编码全局结构,后部 Token 负责细节精修。推理时可动态调整潜在 Token 数量以匹配算力预算。 核心创新 即插即用:仅增加两个跨注意力层,不修改 DiT 主体和 rectified flow 训练目标 重要性排序表示:通过尾部 Token 随机丢弃训练,自动学习全局到细节的分层编码 跨架构通用:兼容 DiT、U-ViT、HDiT、MM-DiT 四种主流架构 动态推理预算:同一个模型适配从低算力到高算力的多种部署场景 实验结果 ImageNet-1K 512px: FID 提升 35.3%, FDD 提升 39.6% 跨架构验证: DiT, U-ViT, HDiT, MM-DiT 均有一致增益 算力节省: 潜在 Token 数减半时质量仅微降,实现接近 2x 加速 方法流程 输入空间 Token — 图像/视频的空间特征序列 Read Cross-Attn — 空间 Token -> 潜在 Token 自动聚焦重要区域 潜在 Token 序列 — 可变长度 重要性排序 DiT Transformer 块 — 标准 Self-Attention + FFN Write Cross-Attn — 潜在 Token -> 空间 Token 信息回写 弹性输出 — 根据算力预算截断尾部 技术脉络 核心问题: DiT 计算量与分辨率强绑定,无法灵活权衡延迟与质量 前序工作及局限: Token Merging:合并相似 token 但损失信息 JiT:动态跳过但仍在空间 token 上运算 Perceiver:潜在 token 但未针对扩散优化 DiTFastAttn:固定模式稀疏化 与前序工作的本质区别: 将空间 token 和计算完全解耦,通过可学习潜在接口实现按重要性排序的信息压缩 技术演进定位: 范式创新——从在空间 token 上省计算转变为在潜在接口上做计算 可能的后续方向: 与 token 合并/跳过组合 视频 DiT 时空弹性接口 与 KV 缓存压缩联合优化 批判性点评 实验评估: 跨 4 种 DiT 架构验证扎实。但缺少真实 T2I 模型端到端评估。 新颖性: 潜在接口+重要性排序+弹性推理是扎实新贡献。创新性:4/5 可复现性: 方法清晰架构改动最小。 影响力: 影响力 5/5 — 一个模型多预算对工业部署极有价值。 2. DreamVideo-Omni: Multi-Subject Video Customization with Omni-Motion Control 全方位运动控制视频定制 | 潜在身份强化学习 | arXiv:2603.12257 关键词: 视频定制, 多主体, 运动控制, 身份RL 研究动机 大规模视频扩散模型已能生成高质量视频,但同时精确控制多个主体的身份和多粒度运动仍然是重大挑战。现有方法要么运动粒度有限、要么身份退化严重。 方法原理 提出 DreamVideo-Omni 统一框架,采用渐进式两阶段训练。第一阶段:集成全面控制信号,引入条件感知 3D 旋转位置嵌入协调异构输入,分层运动注入策略增强全局运动引导,分组与角色嵌入将运动信号锚定到特定身份。第二阶段:设计潜在身份奖励反馈学习范式,在预训练视频扩散骨干上训练潜在身份奖励模型,在潜在空间提供运动感知的身份奖励。 核心创新 首个统一框架同时实现多主体身份定制 + 全方位运动控制 条件感知 3D RoPE:解决异构控制信号的空间对齐问题 分组与角色嵌入:显式解纠缠复杂场景中多主体的运动信号 潜在身份奖励学习:在潜在空间中构建运动感知的身份 RM 实验结果 多主体身份保持: 超越所有现有基线 运动控制精度: 全局、局部、相机三粒度均达到 SOTA 新基准 DreamOmni Bench: 专门评估多主体+全方位运动控制 方法流程 多模态输入 — 主体图像 + 文本 + 运动轨迹 3D RoPE 编码 — 条件感知旋转位置嵌入 分组角色嵌入 — 运动信号锚定到特定身份 分层运动注入 — 全局+局部+相机分层控制 视频扩散去噪 — DiT 多粒度条件引导 身份奖励 RL — 潜在空间身份 RM 优化 技术脉络 核心问题: 多主体身份保持和多粒度运动控制难以兼顾 前序工作及局限: DreamBooth:仅单主体 AnimateDiff:运动粒度有限 MotionCtrl:身份保持弱 IP-Adapter:多主体时身份混淆 与前序工作的本质区别: 统一多主体身份、全局运动、局部动态、相机控制,用潜在身份奖励 RL 解决身份退化 技术演进定位: 集大成者——统一视频定制分散的研究方向 可能的后续方向: 5+主体可扩展性 3D 感知运动控制融合 长视频身份一致性 批判性点评 实验评估: DreamOmni Bench 是重要贡献。RL 训练稳定性需更多消融。 新颖性: 统一多个控制维度是工程突破。创新性:4/5 可复现性: 框架复杂度较高,复现门槛不低。 影响力: 影响力 4/5 — 方向正确但框架复杂度可能限制采用。 3. FIRM: Faithful Image Reward Modeling for Editing and Generation 鲁棒奖励模型 | FIRM-Edit-370K | 全套开源 | arXiv:2603.12247 关键词: 奖励模型, 图像编辑, RLHF, Benchmark 研究动机 RL 正成为提升图像编辑和 T2I 生成的主要范式,但当前奖励模型存在严重的幻觉问题,给出噪声评分从根本上误导优化方向。 方法原理 提出 FIRM 框架:定制化数据策划管道构建高质量评分数据集(Edit-370K + Gen-293K),训练专业化奖励模型(Edit-8B + Gen-8B)。设计 Base-and-Bonus 奖励策略——编辑用一致性调制执行 CME,生成用质量调制对齐 QMA——平衡竞争目标。提出 FIRM-Bench 综合评测基准。 核心创新 首个专门针对编辑和生成的大规模奖励模型框架 FIRM-Edit-370K + FIRM-Gen-293K: 共 66 万高质量评分数据 Base-and-Bonus 奖励策略: CME 和 QMA 平衡竞争目标 全套开源: 数据集、模型、代码均公开 实验结果 FIRM-Edit-8B: 与人类判断对齐度显著超越现有指标 FIRM-Qwen-Edit: 编辑性能突破性提升 FIRM-SD3.5: 生成保真度和指令遵循新标准 数据集+模型+代码: 全部开源 方法流程 数据策划管道 — 编辑: 执行+一致性; 生成: 指令遵循 FIRM 数据集 — Edit-370K + Gen-293K 专业化 RM 训练 — Edit-8B + Gen-8B Base-and-Bonus — CME + QMA 策略 RL 微调 — 可靠 Critic 引导优化 高保真输出 — FIRM-Qwen-Edit / SD3.5 技术脉络 核心问题: RL 优化时奖励模型幻觉导致噪声评分误导优化 前序工作及局限: ImageReward:通用偏好不专门针对编辑 HPS v2:未拆分编辑vs生成 DDPO:使用通用奖励 InstructPix2Pix:无专门 Critic 与前序工作的本质区别: 首次为编辑和生成分别构建大规模评分数据集和专业化奖励模型 技术演进定位: 基础设施建设——为扩散模型 RL 提供可靠 Critic 可能的后续方向: 视频编辑/生成 RM 多轮交互编辑序列化奖励 跨模型迁移性 批判性点评 实验评估: 66 万数据集规模可观,FIRM-Bench 设计系统性强。 新颖性: 可靠 Critic 比聪明 Policy 更重要的洞察深刻。创新性:4/5 可复现性: 全套开源,可复现性极佳。 影响力: 影响力 5/5 — 可能成为扩散模型 RLHF 基础设施。 4. ShotVerse: Cinematic Camera Control for Multi-Shot Video 电影级多镜头视频创作 | Plan-then-Control | arXiv:2603.11421 关键词: 多镜头视频, 相机控制, VLM 规划, 数据驱动 研究动机 文本驱动视频生成在多镜头场景中的相机控制仍是关键瓶颈:隐式文本提示缺乏精确性,显式轨迹条件带来巨大手动开销且执行常失败。 方法原理 提出以数据为核心的范式:对齐的 (Caption,Trajectory,Video) 三元组构成联合分布。构建 Plan-then-Control 框架:VLM 规划器从文本生成全局对齐轨迹,控制器通过相机适配器渲染多镜头视频。核心是自动化多镜头相机校准管线和 ShotVerse-Bench 数据集。 核心创新 Plan-then-Control 解耦: VLM 规划 + 控制器渲染 自动化多镜头相机校准: 统一全局坐标系 ShotVerse-Bench: 高保真电影数据集 + 三轨评测 跨镜头一致性: 相机准确+视觉连贯 实验结果 相机轨迹准确性: 显著超越文本控制和手动轨迹基线 跨镜头一致性: 多镜头间视觉连贯达到电影级标准 用户研究: 电影美学评分大幅领先 方法流程 文本脚本输入 — 自然语言描述场景和相机意图 VLM 规划器 — 空间先验推理 生成全局轨迹 多镜头校准 — 单镜头轨迹对齐到全局坐标系 相机适配器 — 轨迹条件注入视频生成模型 多镜头渲染 — 跨镜头一致的电影级画面 技术脉络 核心问题: 多镜头视频相机控制缺少文本自然表达和精确控制之间的桥梁 前序工作及局限: CameraCtrl:仅单镜头 MotionCtrl:无跨镜头一致性 Animate-A-Story:相机控制弱 Direct-a-Video:仅单镜头 与前序工作的本质区别: 数据驱动的联合分布学习,VLM 规划+控制器执行,实现端到端多镜头视频管线 技术演进定位: 应用创新——首次解决多镜头电影级相机控制 可能的后续方向: 10+镜头一致性 渲染引擎集成 导演意图交互精调 批判性点评 实验评估: 三轨评测协议有价值。与单镜头方法缺少直接对比。 新颖性: Plan-then-Control 简洁优雅。创新性:3/5 可复现性: 工程复杂度较高。 影响力: 影响力 4/5 — 多镜头控制是走向影视级应用的关键。 5. EndoCoT: Endogenous Chain-of-Thought Reasoning in Diffusion Models 扩散模型内生思维链 | MLLM+DiT 深度推理 | arXiv:2603.12252 关键词: 思维链, 扩散模型, 空间推理, MLLM+DiT 研究动机 MLLM 作为扩散框架的文本编码器时,单步编码无法激活思维链过程推理深度不足,且解码过程中引导固定不变。 方法原理 提出 EndoCoT 框架:迭代思维引导模块在潜在空间中迭代优化思维状态,激活 MLLM 推理潜力并桥接到 DiT 去噪过程。终端思维锚定模块将最终状态与真实答案对齐,确保推理不漂移。两个组件让 MLLM 提供精心推理的引导,DiT 逐步执行复杂任务。 核心创新 首次在扩散模型中实现内源性思维链推理 迭代思维引导模块: 在潜在空间逐步精炼推理状态 终端思维锚定: 推理轨迹与真实答案对齐防止漂移 MLLM+DiT 渐进式推理引导: 复杂任务逐步分解 实验结果 整体平均准确率: 92.1%, 超越最强基线 8.3 个百分点 Maze/TSP/VSP/Sudoku 等复杂推理均达 SOTA 23 页论文 18 张图: 全面消融实验 方法流程 复杂指令输入 — 迷宫/TSP/数独等推理任务 MLLM 编码器 — 初始编码 激活推理起点 迭代思维引导 — 潜在空间逐步精炼推理 终端思维锚定 — 与真实答案对齐防漂移 DiT 渐进去噪 — 推理引导的逐步去噪 推理一致输出 — 高质量生成结果 技术脉络 核心问题: MLLM 编码器单步编码推理深度不足,解码过程引导固定 前序工作及局限: DALL-E 3:T5 编码无推理 RPG:外部推理非内源 LLM Blueprint:与去噪过程脱耦 PixArt-alpha:无迭代推理 与前序工作的本质区别: 将 CoT 从外部规划内化到去噪过程中,MLLM 成为迭代推理器而非一次性编码器 技术演进定位: 范式转换——从外部推理+内部生成转为内源性推理-生成一体化 可能的后续方向: 通用 T2I 组合推理 推理步数自适应 与 o1 推理模型结合 批判性点评 实验评估: 92.1% 准确率令人印象深刻但在逻辑推理任务而非典型视觉生成。 新颖性: CoT 内化到去噪过程是概念重大创新。创新性:5/5 可复现性: 实现复杂度较高。 影响力: 影响力 4/5 — 如能推广到通用 T2I 将是变革性的。 批判性点评精选 1. DiT 加速:从 Token 级优化到架构级解耦 ELIT 将 DiT 加速从 token 粒度提升到架构级别。关键问题:在 FLUX/SD3 上是否仍成立? 2. 视觉生成 RLHF 时代正式开启 FIRM 66 万评分数据+全套开源,标志扩散模型从探索期进入基础设施建设期。 3. 思维链内化:扩散模型的慢思考能力 EndoCoT 让扩散模型拥有类似 o1 的推理能力,92.1% 证明方向可行。 其余论文 · 贡献与效果总结 # 论文 关键词 主要贡献 效果 1 EVATok (Adaptive Length Video Tokenization for AR Generation) 视频 Token . AR 生成 . CVPR 2026 自适应长度视频 Tokenizer,轻量路由器预测最优 Token 分配 UCF-101 SOTA,Token 节省 24.4%+ (CVPR 2026) 2 MOG (Manifold-Optimal Guidance for Diffusion Models) CFG 改进 . 黎曼几何 . 无训练 黎曼流形局部最优控制修复 CFG 离流形漂移,Auto-MOG 动态校准 消除 CFG 过饱和,几乎零额外开销 3 WeEdit (Glyph-Guided Text-centric Image Editing) 文本编辑 . 字形引导 . 多语言 HTML 管道生成 33 万训练对(15 种语言),字形引导 SFT + 多目标 RL 文本编辑准确率超越所有开源模型 4 SoulX-LiveAct (Hour-Scale Real-Time Human Animation) 实时动画 . AR 扩散 . 无限视频 Neighbor Forcing(扩散步对齐) + ConvKV 固定内存无限视频 小时级 20FPS 实时(2x H100),唇形/情感 SOTA 5 PROMO (Promptable Virtual Try-On with Flow Matching DiT) 虚拟试穿 . Flow Matching . DiT VTON 重定义为结构化编辑,FM-DiT + 潜在多模态条件 + 自参考加速 保真度超所有 VTON 方法,速度质量最优 6 CEI-3D (Collaborative Explicit-Implicit 3D Editing) 3D 编辑 . SDF+点 . 属性解耦 隐式 SDF + 显式处理点协作,物理属性解耦独立控制 比 SOTA 更逼真精细,编辑时间更短 7 OSCBench (Object State Change in T2V Generation) T2V 评测 . 状态变化 . Benchmark 首个评估 T2V 中对象状态变化的基准,组织为常规/新颖/组合场景 揭示当前 T2V 在状态变化上的重大不足 8 Coarse-Guided VG (Visual Generation via h-Transform Sampling) 引导采样 . h-Transform . 无训练 h-Transform 约束扩散采样,噪声感知调度平衡引导与质量 多种图像视频任务验证有效 趋势观察 DiT 效率革命从 token 级走向架构级 — ELIT 的潜在接口方案预示着 DiT 加速的新范式 视频定制进入多主体+全方位运动时代 — DreamVideo-Omni 统一了身份、运动、相机三个维度 扩散模型 RLHF 基础设施加速完善 — FIRM 66 万评分数据+专业化 RM 开源 多镜头视频创作工具链逐步成形 — ShotVerse 的 Plan-then-Control 让电影级创作更近 扩散模型的推理能力被正式重视 — EndoCoT 将 CoT 内化到去噪过程,开辟新方向 人工智能炼丹师 整理 | 2026-03-16 -